OpenAdapter

Foto: Product Hunt AI

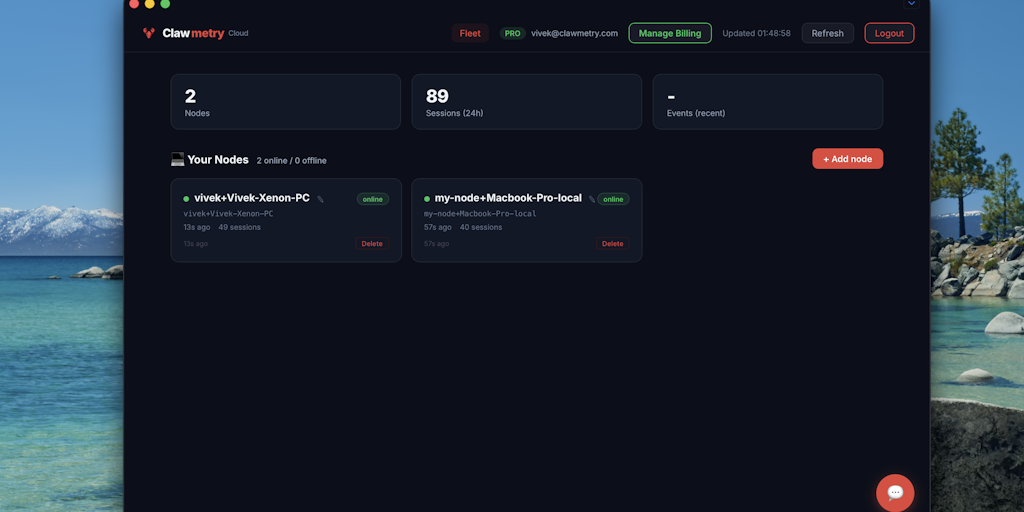

OpenAdapter to nowa platforma, która łączy dostęp do wielu modeli open-source'owych — Minimax, GLM, Qwen, Mistral i Kimi — w ramach jednego planu subskrypcji. Rozwiązanie eliminuje konieczność żonglowania między różnymi usługami kodowania, oferując interfejs wspólny dla popularnych edytorów jak Cursor, ClaudeCode czy Opencode. Główną zaletą jest brak vendor lock-in — użytkownicy nie są przywiązani do jednego dostawcy i mogą swobodnie wybierać między modelami w zależności od potrzeb. Platforma startuje z opcją darmową, a jej założeniem jest uproszczenie workflow'u programistów, którzy dotychczas musieli zarządzać wieloma klientami i subskrypcjami jednocześnie. OpenAdapter trafia na rynek w momencie, gdy konkurencja między narzędziami AI do kodowania intensyfikuje się. Dla deweloperów oznacza to praktyczną alternatywę dla rozwiązań zamkniętych, zwłaszcza że modele open-source'owe coraz częściej dorównują proprietary'owym pod względem wydajności. To szczególnie ważne dla zespołów szukających elastyczności i niezależności technologicznej.

W świecie programowania zdarza się coś, co można by nazwać fragmentacją narzędziową. Deweloper pracujący nad projektem musi często żonglować kilkoma subskrypcjami: jedną do ChatGPT, drugą do Claude, trzecią do specjalistycznego narzędzia dla konkretnego modelu open-source'owego. Każda z tych platform ma swoją logikę, swój interfejs, swoje limity. OpenAdapter pojawia się na rynku z obietnicą przełamania tego chaosu — jedną płacę, dostęp do całej armady najnowocześniejszych modeli open-source'owych, integracja z edytorami kodu, które deweloperzy już znają i kochają. To nie jest zwykła agregacja modeli. To jest próba redefinicji tego, jak pracuje się z sztuczną inteligencją w edytorze kodu.

Projekt trafił na Product Hunt z ambitnym hasłem: „Każdy model SOTA open-source'owy w Twoim edytorze". W praktyce oznacza to dostęp do Minimaxa, GLM-4, Qwena, Mistrala i Kimi — modeli, które w ostatnich miesiącach wykazały się imponującymi wynikami w benchmarkach, czasem konkurując z własnościowymi rozwiązaniami OpenAI czy Google'a. Ale to nie jest artykuł o kolejnym agregatorze modeli. To jest historia o tym, jak zmienia się dynamika rynku AI, kiedy open-source przestaje być alternatywą dla ubogich, a staje się strategicznym wyborem dla świadomych deweloperów.

Model open-source'owy stał się rzeczywiście dobrą opcją

Przez lata open-source'owe modele językowe były traktowane jak drożdżak na torcie — miłe mieć, ale nigdy nie były pierwszym wyborem, gdy liczyła się wydajność. GPT-4 dominował, Claude zdobywał fanów, a modele otwarte były dla entuzjastów i purystów. Sytuacja diametralnie się zmieniła. Dziś Qwen2.5 czy Mistral Large regularnie zajmują miejsca w czołówce benchmarków kodowania, czasami pokonując starsze wersje GPT-4. Kimi, chiński model od Moonshot AI, wykazuje się niezwykłymi umiejętnościami w kodowaniu z kontekstem do 200 tysięcy tokenów.

Lee también

Co to oznacza praktycznie? Oznacza to, że deweloper pracujący nad projektem nie musi już kompromisować wydajności, wybierając open-source. Oznacza to również, że nie ma już wymawiania „ale GPT-4 to robi lepiej" — bo w wielu scenariuszach robi to równie dobrze lub lepiej. Taka zmiana jest fundamentalna dla całego ekosystemu. Kiedy model open-source'owy jest równie kompetentny, pytanie nie brzmi już „czy to zadziała", ale „czemu miałbym płacić więcej za zamknięte rozwiązanie?"

OpenAdapter pojawia się dokładnie w tym momencie przełomu. Projekt rozumie, że problem nie jest w dostępności modeli — każdy z nich można uruchomić za darmo, jeśli się wie gdzie szukać. Problem jest w doświadczeniu użytkownika. Chcesz porównać, jak Qwen radzi sobie z Twoim problemem kodowania w stosunku do Mistrala? Musisz przełączać się między platformami. Chcesz użyć Kimi w swoim ulubionym edytorze? Czekaj, on nie ma tam integracji. OpenAdapter likwiduje te tarcia.

Integracja z ekosystemem edytorów — gdzie rzeczywista wartość

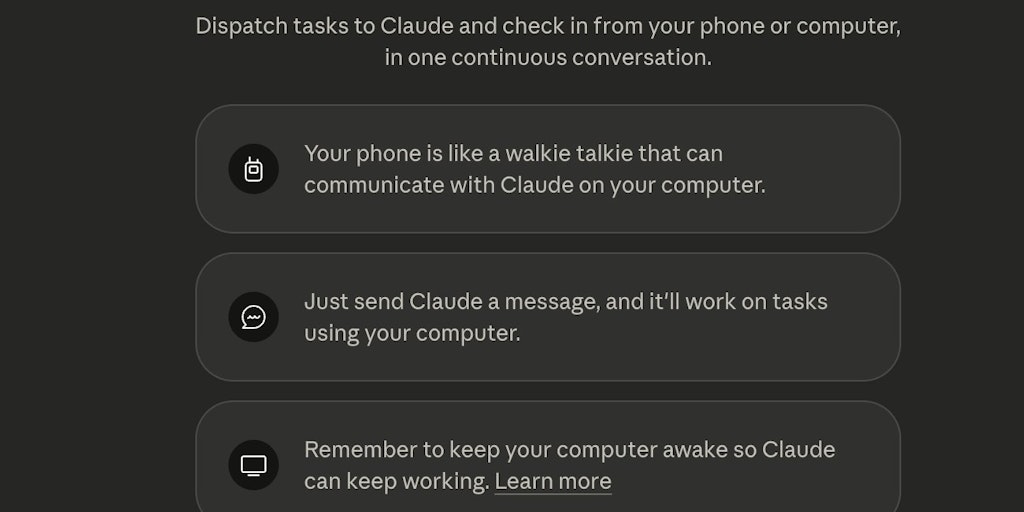

Współpraca z Cursor, Claude Code, Opencode i „każdym innym IDE" to nie jest tylko feature list — to jest strategiczne ustawienie się w sercu workflow'u dewelopera. Edytor kodu to miejsce, gdzie spędzasz osiem godzin dziennie, jeśli jesteś programistą. To jest Twoja druga strona mózgu. Każde przełączenie się do innego narzędzia to koszt poznawczy, przerwa w przepływie pracy, szansa na utratę kontekstu.

OpenAdapter zrozumiał tę psychologię. Zamiast budować kolejny IDE (czego już jest za dużo), integruje się z istniejącymi narzędziami. To podejście nawiązuje do tego, co robi GitHub Copilot — ale z jedną kluczową różnicą. Copilot to jedno rozwiązanie, jeden model (właściwie kilka, ale pod jednym parasolem OpenAI). OpenAdapter to pluralizm. To możliwość powiedzenia: „Dzisiaj chcę pracować z Qwenem, jutro spróbuję Mistrala, a w piątek może Kimi."

Dla polskich deweloperów ta integracja ma dodatkowe znaczenie. Polskie narzędzia kodowania, jeśli ktoś je tworzy, mogą teraz łatwo podpiąć się pod OpenAdapter, zamiast budować własne integracje z każdym modelem z osobna. To znacznie obniża barierę wejścia dla lokalnych startupów toolingowych. Zamiast negocjowania dostępu do API z każdym dostawcą modelu, wystarczy jedna integracja.

Model biznesowy bez lock-inu — czy to naprawdę gra bez pułapek?

Hasło „no lock-in" pojawia się w opisie OpenAdapter wielokrotnie, i to nie jest przypadek. To jest bezpośrednia odpowiedź na frustrację, którą czuje każdy, kto kiedykolwiek zbudował coś na API OpenAI, a potem zobaczył zmianę cen. Lock-in to słowo klucze w dyskusji o AI toolingu. Kiedy inwestujesz w narzędzie, które pracuje tylko z jednym modelem, faktycznie inwestujesz w tego dostawcę. Zmienia ceny? Jesteś uwięziony. Zmienia politykę? Jesteś uwięziony.

OpenAdapter obiecuje, że tego nie będzie. Ale tu pojawia się pytanie, które każdy doświadczony deweloper powinien sobie zadać: czy rzeczywiście jest to tak proste? Każdy z tych modeli ma nieco inny API, nieco inne zachowanie, różne limity tokenów, różne specjalizacje. OpenAdapter musiałby być niezwykle sprytnie zaprojektowany, aby abstrakcjonować te różnice bez utraty wydajności. Jeśli to robi źle, „brak lock-inu" może się okazać równy „brak konsystencji".

Z dostępnych informacji wynika, że OpenAdapter oferuje darmowy plan startowy. To jest mądra decyzja — pozwala deweloperom przetestować, czy abstrakcja rzeczywiście działa, zanim się zaangażują finansowo. Ale to również sugeruje, że monetyzacja będzie na wyższych poziomach. Pytanie brzmi: czy ta monetyzacja będzie konkurencyjna wobec bezpośredniego korzystania z API modeli open-source'owych, które często są darmowe lub bardzo tanie?

Porównanie z konkurencją — dlaczego nie po prostu Ollama?

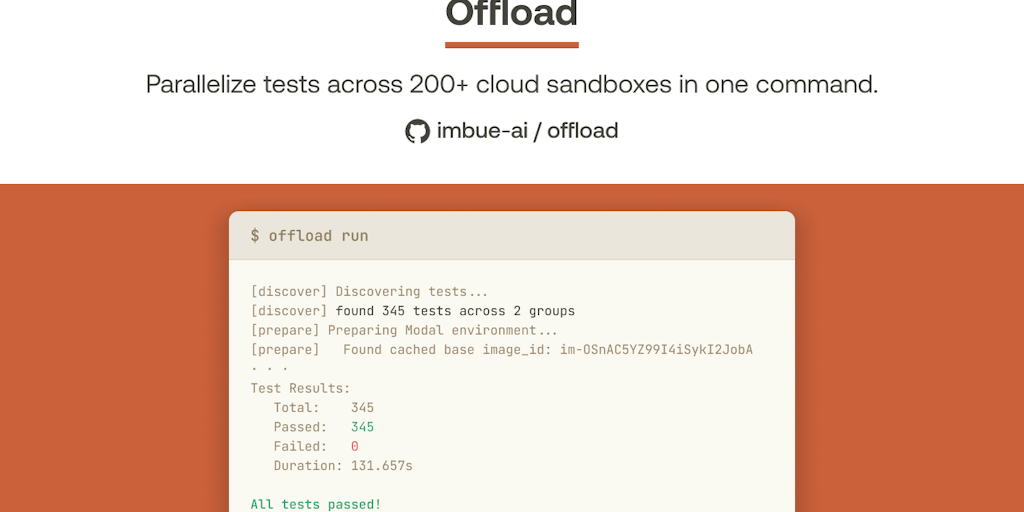

Ollama pozwala uruchamiać modele open-source'owe lokalnie. LM Studio daje graficzny interfejs. vLLM pozwala skalować. Każde z tych narzędzi rozwiązuje część problemu. Pytanie, które OpenAdapter musi sobie zadać, to: dlaczego ktoś miałby płacić za usługę, kiedy może postawić Ollamę na swoim laptopie za darmo?

Odpowiedź jest prosta, ale wymaga zrozumienia różnych segmentów rynku. Nie każdy deweloper chce zarządzać infrastrukturą. Nie każdy ma GPU zdolne do uruchamiania Qwena 72B. Nie każdy chce się martwić o skalowanie, gdy projekt rośnie. OpenAdapter oferuje managed experience — ktoś inny martwi się o serwery, o optymalizację, o to, że model zawsze jest dostępny. To jest warstwa abstrakcji, a za warstwę abstrakcji ludzie płacą.

Ale konkurencja tutaj jest również inna — to nie tylko Ollama. Replicate, Together AI, Anyscale — wszystkie oferują dostęp do modeli open-source'owych przez API. Różnica jest w tym, że OpenAdapter pozycjonuje się jako agregator w edytorze kodu, a nie jako infrastruktura. To jest istotne rozróżnienie. OpenAdapter nie mówi „uruchamiaj modele na naszych serwerach" — mówi „użyj dowolnego modelu, którego chcesz, bez opuszczania edytora".

Wyzwanie integracji z każdym IDE — ambicja czy iluzja?

Obietnica integracji z „każdym innym IDE" to słowa, które powinny wzbudzić zarówno entuzjazm, jak i sceptycyzm. Każdy IDE ma inną architekturę, inny system pluginów, inną logikę. Obsługiwanie Cursora (który ma dobrze udokumentowane API dla AI) to jedno. Obsługiwanie Visual Studio Code (gdzie ekosystem pluginów jest gigantyczny) to drugie. Obsługiwanie WebStorm, Rider, czy Sublime Text to trzecie. Każda integracja to oddzielna praca.

W praktyce, gdy startup mówi „każdy IDE", zwykle oznacza to „planiujemy obsługiwać każdy IDE, ale na razie mamy VS Code i Cursor". To nie jest krytyka — to jest rzeczywistość. Ale to oznacza również, że jeśli używasz mniej popularnego edytora, możesz nie znaleźć wsparcia. Dla polskiego rynku, gdzie Visual Studio Code dominuje, to nie jest problem. Ale to warte pamiętania.

Co jednak ciekawe, OpenAdapter zdaje się rozumieć, że uniwersalna obsługa to długoterminowy cel, a nie punkt startowy. Zamiast obiecywać wszystko od razu, skupia się na kluczowych graczach. To jest dojrzałe podejście. Pokazuje, że zespół myśli strategicznie, a nie robi marketing-first.

Dlaczego to ma znaczenie dla polskiego ekosystemu AI

Polska nie jest liderem w tworzeniu modeli językowych — to fakt. Ale Polska ma solidną społeczność deweloperów, którzy chcą pracować z najnowszymi narzędziami bez bycia całkowicie zależni od rozwiązań amerykańskich. OpenAdapter, pozwalając na łatwe przełączanie między modelami, daje tej społeczności narzędzie. Jeśli pojawi się polski model, który będzie konkurencyjny (a są objawy, że mogą się pojawić), OpenAdapter pozwoli na jego szybką integrację bez czekania na to, aż OpenAI lub Anthropic uznają to za ważne.

Dodatkowo, dla polskich startupów budujących narzędzia AI, OpenAdapter to potencjalny partner. Zamiast budować własne integracje z modelami, mogą się podpiąć pod OpenAdapter i oferować swoim użytkownikom dostęp do całej ekosystemu. To obniża koszty, przyspiesza time-to-market, pozwala skupić się na tym, co naprawdę wyróżnia Twój produkt.

Przeszkody i pytania bez odpowiedzi

OpenAdapter ma jeszcze sporo do wyjaśnienia. Jak dokładnie wygląda abstrakcja API? Czy model działa jednakowo niezależnie od tego, czy korzystasz z Qwena czy Kimi, czy są różnice w zachowaniu? Jakie są limity? Czy jest rate limiting? Jak wygląda dokumentacja dla deweloperów chcących zbudować własne integracje?

Pytanie o ceny jest również kluczowe. Darmowy plan to świetnie, ale ile kosztuje płatny? Czy to będzie tańsze niż bezpośrednie korzystanie z API? Czy będzie droższe, ale z wartością dodaną w postaci managementu infrastruktury? Te odpowiedzi będą decydujące dla adopcji.

Jest też kwestia niezawodności. Jeśli OpenAdapter agreguje dostęp do wielu modeli, co się dzieje, gdy jeden z nich pada? Czy jest fallback? Czy użytkownik musi ręcznie przełączać się na inny? Dla profesjonalnych deweloperów to może być problem — jeśli opierasz się na narzędziu, potrzebujesz gwarancji dostępności.

Czy to jest przyszłość AI toolingu?

OpenAdapter reprezentuje trend, który będzie się nasilać: pluralizm modeli. Czasy, gdy jeden model (GPT-4) dominował wszystko, powoli się kończą. Przyszłość wygląda bardziej jak ekosystem, gdzie różne modele są dobre w różnych rzeczach, a deweloperzy wybierają narzędzie najlepiej dostosowane do zadania. OpenAdapter jest próbą zbudowania interfejsu dla tego ekosystemu.

Jeśli projekt się powiedzie, może stać się standardem — narzędziem, które każdy IDE integruje domyślnie, bo oferuje dostęp do całej armady modeli bez dodatkowej konfiguracji. Jeśli się nie powiedzie, będzie to kolejny agregator, który zniknie w szumie nowych startupów AI. Ale nawet jeśli to drugie, fakt, że taki projekt powstaje, pokazuje, że rynek dojrzewa. Pokazuje, że ludzie myślą o tym, jak pracować z AI bardziej inteligentnie, a nie tylko szybciej.

Dla polskich deweloperów, którzy chcą być na czele trendów technologicznych, OpenAdapter warto obserwować. Niekoniecznie od razu do niego inwestować — ale zrozumieć, co robi i dlaczego, to jest warte czasu. Bo niezależnie od tego, czy ten konkretny projekt się powiedzie, trend, który reprezentuje, na pewno się powiedzie.

Más de Herramientas

Artículos relacionados

Zaplanowane

10h

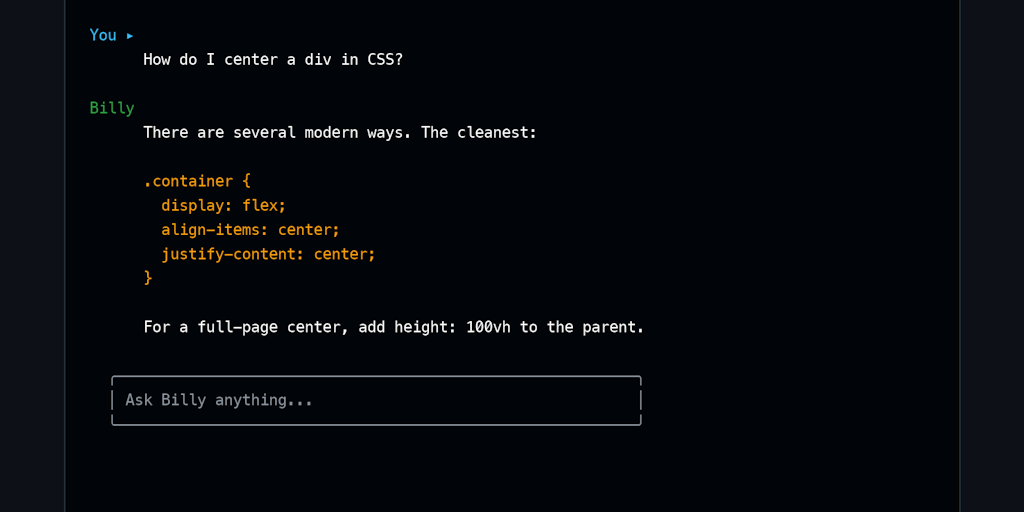

I'd be happy to help translate an English news headline to Polish, but I don't see a headline in your message. You've only provided "Billy.sh" which appears to be a filename or reference. Could you please provide the actual English headline you'd like me to translate?

10h

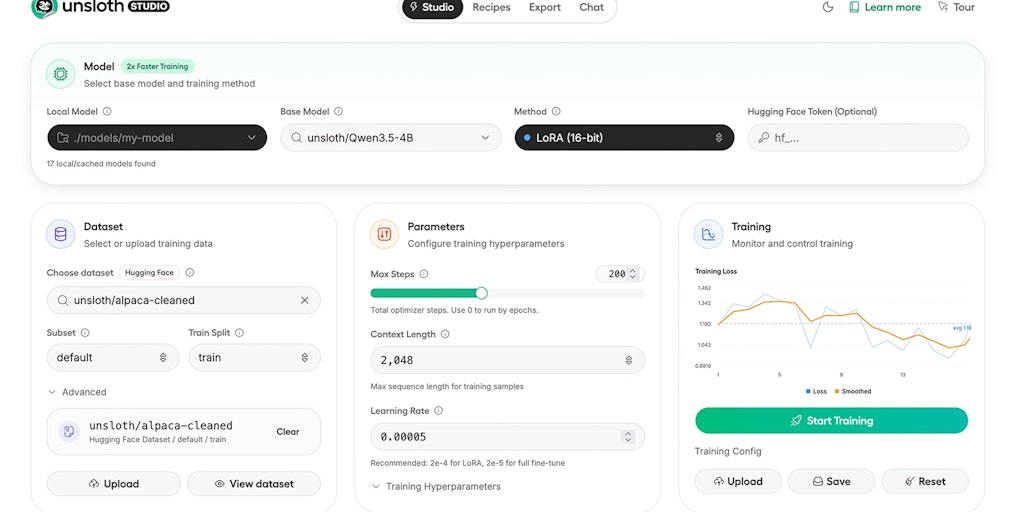

Unsloth Studio

18 mar