I'd be happy to help translate an English news headline to Polish, but I don't see a headline in your message. You've only provided "Billy.sh" which appears to be a filename or reference. Could you please provide the actual English headline you'd like me to translate?

Foto: Product Hunt AI

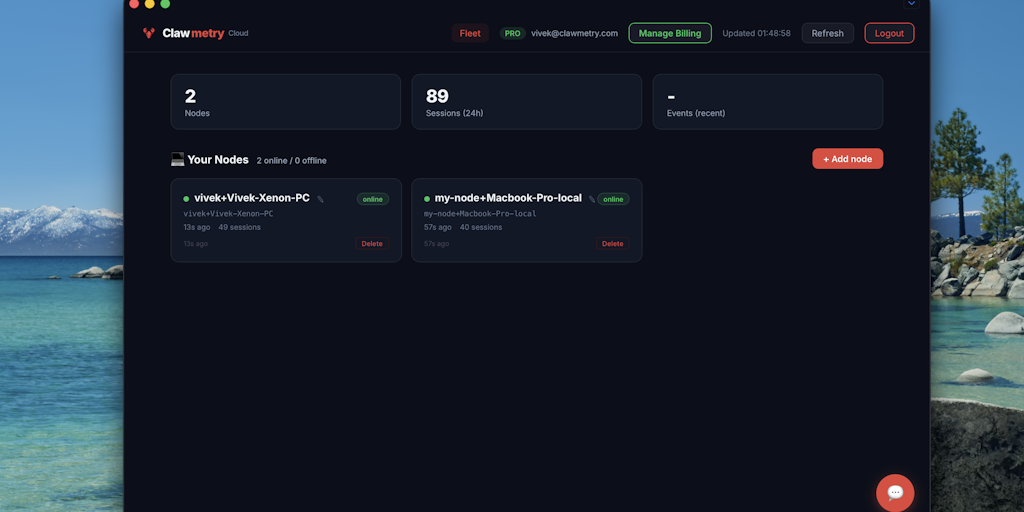

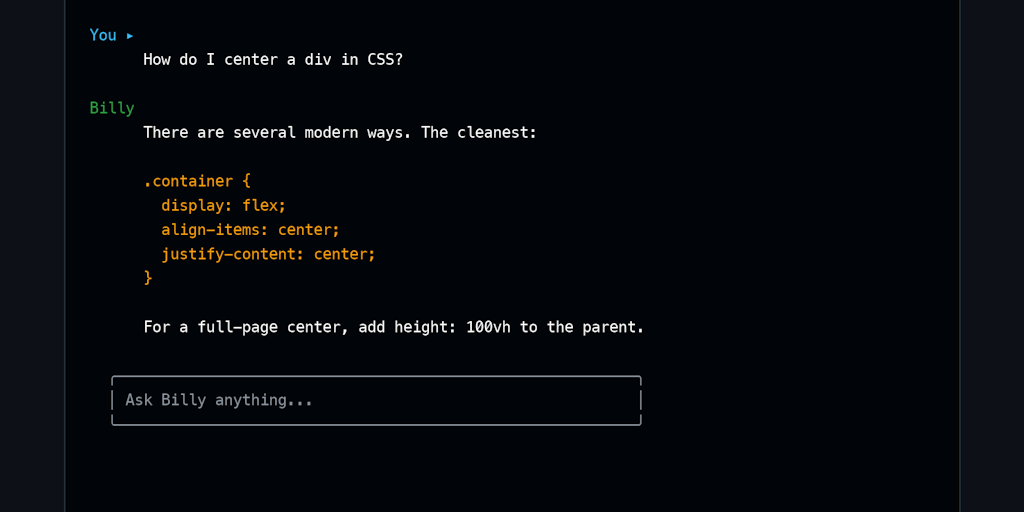

Billy.sh to asystent AI do kodowania działający bezpośrednio w terminalu, zasilany przez Ollama. W przeciwieństwie do chmurowych rozwiązań takich jak GitHub Copilot, narzędzie wykonuje się całkowicie na lokalnym komputerze użytkownika, co oznacza pełną prywatność kodu i możliwość pracy offline. Kluczową zaletą Billy.sh jest pamięć kontekstu między sesjami — asystent zapamiętuje historię rozmów i może wznowić poprzednie czaty. Dodatkowo może sugerować lub uruchamiać polecenia shell'a, ale wyłącznie za zgodą użytkownika. Producent oferuje też spakowaną wersję z Ollama w zestawie, co drastycznie przyspiesza konfigurację. Narzędzie dostępne jest w wersji darmowej, a upgrade Pro zaczyna się od 19 dolarów jednorazowej opłaty. Dla programistów pracujących z wrażliwymi kodami lub preferujących niezależność od usług chmurowych to solidna alternatywa. Billy.sh trafia na rynek w momencie, gdy coraz więcej deweloperów szuka lokalnych rozwiązań AI, które nie wysyłają ich pracy na serwery zewnętrzne.

Terminal stał się ostatnio polem bitwy dla asystentów AI. Każdy wielki gracz — od OpenAI z Copilot CLI po GitHub Copilot — próbuje wcisnąć się w narzędzie, którym deweloperzy żyją od dziesięcioleci. Ale Billy.sh podchodzi do tego inaczej. Zamiast wysyłać kod do chmury, gdzie może być przetwarzany, przechowywany i analizowany, Billy trzyma wszystko lokalnie. To nie jest małe rozróżnienie — to fundamentalna zmiana podejścia do bezpieczeństwa, prywatności i niezależności deweloperów.

Nowy asystent, który właśnie pojawił się na Product Hunt, wykorzystuje Ollama — platformę do uruchamiania dużych modeli języka na własnym sprzęcie. Billy.sh to terminal-native'owy AI coding assistant, który działa w całości na twojej maszynie, bez konieczności połączenia z serwerami jakiejkolwiek korporacji. Brzmi jak rozwiązanie dla paranoików? Może. Ale to również rozwiązanie dla profesjonalistów pracujących z kodem wrażliwym, dla firm, które nie chcą dzielić się swoją własnością intelektualną, i dla każdego, kto po prostu woli nie być zależny od dostępności internetu czy limitów API.

Pytanie brzmi: czy lokalne podejście ma szansę konkurować z maszyną marketingową i zasobami gigantów technologicznych? Czy Billy.sh to rzeczywiście przełom, czy tylko niszowe narzędzie dla entuzjastów open source?

Lesen Sie auch

Prywatność jako główna waluta w erze chmury

W momencie, gdy GitHub Copilot i inne cloud-based asystenty dominują rynek, Billy.sh postawił sobie jasny cel: żaden twój kod nie opuszcza twojego komputera. To nie jest abstrakcyjna obietnica — to architektura systemu. Kiedy używasz Billy.sh, model AI działa lokalnie poprzez Ollama, co oznacza, że wszystkie zapytania, wszystkie fragmenty kodu, wszystkie zmienne i logika biznesowa pozostają w twoim katalogu domowym.

Dla wielu deweloperów jest to sprawa kluczowa. Pracując nad projektami dla klientów, startupów czy własnych produktów, nikt nie chce, aby jego kod był przesyłany do serwerów Microsoftu, OpenAI czy jakiegokolwiek innego dostawcy. Nie chodzi tu o paranoję — to rzeczywisty problem bezpieczeństwa. Każde połączenie z chmurą to potencjalny wektor ataku, każde przesłanie danych to narażenie na wyciek, każde logowanie to ślad, który może być wykorzystany.

Billy.sh rozwiązuje ten problem elegancko. Model AI, którym dysponuje, to zazwyczaj Llama, Mistral lub inne modele open source dostępne przez Ollama. Są one mniejsze niż GPT-4 czy Claude, ale dla większości zadań kodowania — od uzupełniania kodu po wyjaśnianie błędów — są w zupełności wystarczające. A najważniejsze: działają offline, bez żadnych połączeń z internetem, jeśli tylko chcesz.

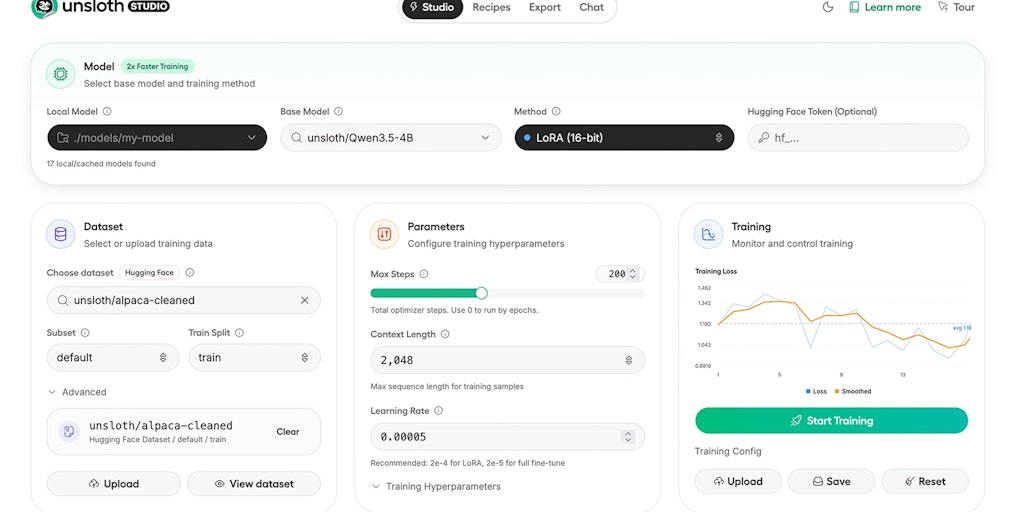

Ollama jako fundament: prostota i kontrola

Aby zrozumieć, dlaczego Billy.sh ma potencjał, trzeba najpierw zrozumieć Ollama. To narzędzie, które pojawiło się stosunkowo niedawno, ale zyskało ogromną popularność wśród developerów, którzy chcą eksperymentować z modelami AI bez konieczności konfigurowania GPU, CUDA czy innych zawiłości. Ollama abstrahuje wszystkie te techniczne szczegóły i pozwala po prostu pobrać model i zacząć go używać.

Billy.sh buduje na tej prostocie. Zamiast zmuszać użytkownika do ręcznej instalacji Ollama, konfiguracji modeli i pisania skryptów, Billy oferuje bundled build z Ollama już wbudowanym. Pobierasz Billy, uruchamiasz instalator, i gotowe — masz działającego AI asystenta w terminalu bez żadnych dodatkowych kroków. To jest kluczowe dla adopcji. Większość deweloperów nie chce spędzać godzin na konfiguracji, chce po prostu zacząć pracować.

Kontrola, którą Billy.sh daje użytkownikowi, to jego druga siła. Możesz wybrać, który model chcesz uruchomić. Chcesz mniejszy, szybszy model dla laptopa z ograniczoną mocą? Wybierz Mistral 7B. Chcesz coś bardziej zaawansowanego? Zainstaluj Llama 2 13B. Wszystko jest pod twoją kontrolą, a Billy.sh działa z każdym z nich.

Funkcjonalności, które liczą się w praktyce

Billy.sh nie jest tylko asystentem, który odpowiada na pytania. To narzędzie zbudowane z myślą o rzeczywistym workflow developera. Pierwsza kluczowa funkcja to zapamiętywanie kontekstu między sesjami. Zamykasz terminal, wracasz do projektu następnego dnia, a Billy wie, nad czym pracowałeś. To wydaje się proste, ale w praktyce zmienia wszystko. Nie musisz powtarzać sobie, jaki jest kontekst projektu, jakie są ograniczenia, jaki jest style guide — Billy to wszystko pamięta.

Druga funkcja to możliwość sugerowania i uruchamiania poleceń shell'a. To jest niebezpieczne, jeśli będzie zrobione źle — ostatnie, czego chcesz, to aby AI bez twojej zgody uruchamiało komendy na twoim komputerze. Billy.sh rozwiązuje to poprzez wymóg jawnej zgody. AI sugeruje polecenie, ty je przeglądasz, a dopiero po twojej akceptacji jest uruchamiane. To jest balans między produktywnością a bezpieczeństwem.

Trzecia funkcja to wznowienie historii czatu. Jeśli w trakcie pracy przerwiesz pracę z Billym, możesz wrócić do poprzedniej rozmowy. To nie jest zapamiętywanie tylko ostatniej sesji — to pełna historia konwersacji, którą możesz przeglądać, analizować i budować na niej.

- Prywatność na poziomie systemu — żaden kod nie opuszcza twojego komputera

- Praca offline — nie potrzebujesz internetu, aby korzystać z asystenta

- Zapamiętywanie kontekstu — Billy wie, nad czym pracujesz i jaki jest kontekst projektu

- Sugerowanie poleceń — z wymogiem jawnej zgody przed wykonaniem

- Historia czatu — wznowienie poprzednich rozmów i budowanie na nich

- Bundled Ollama — instalacja w jednym kroku bez dodatkowej konfiguracji

Model cenowy: darmowy plus opcjonalna premię

Billy.sh oferuje model freemium, który jest uczciwy i przejrzysty. Darmowa wersja daje ci dostęp do wszystkich podstawowych funkcji — możesz uruchamiać modele open source, pracować offline, korzystać z zapamiętywania kontekstu. Nie ma limitów na liczbę zapytań, nie ma watermarków, nie ma nacisku na upgrade.

Jeśli chcesz więcej, Pro upgrade kosztuje jednorazowo $19. To jest cena, którą wielu deweloperów zapłaci bez wahania — to mniej niż jedno pełne paczki kawy w przyzwoitej kawiarni. Za tę kwotę otrzymujesz dostęp do bardziej zaawansowanych funkcji, potencjalnie lepszą obsługę, może integracje z innymi narzędziami. Ale nawet bez tego, darmowa wersja jest w pełni funkcjonalna.

To podejście do ceny jest bardzo różne od modelu subskrypcyjnego, który preferuje GitHub Copilot czy OpenAI. Tam płacisz co miesiąc, zawsze. Tutaj płacisz raz, jeśli chcesz. To jest psychologicznie inne i dla wielu użytkowników bardziej atrakcyjne.

Gdzie Billy.sh naprawdę błyska — i gdzie ma ograniczenia

Billy.sh jest doskonały do kilku konkretnych scenariuszy. Jeśli pracujesz z kodem wrażliwym — finansowym, medycznym, militarnym — lokalna prywatność jest nie do negocjacji. Jeśli pracujesz w środowisku bez dostępu do internetu lub z bardzo ograniczonym dostępem, Billy.sh jest jedynym praktycznym rozwiązaniem. Jeśli nie chcesz być uzależniony od dostępności API czy limitów OpenAI, Billy.sh daje ci niezależność.

Ale jest też druga strona medalu. Modele open source, którymi dysponuje Billy.sh, są mniejsze i mniej zaawansowane niż GPT-4 czy Claude 3. Dla prostych zadań — uzupełnianie kodu, wyjaśnianie błędów, refaktoryzacja — to nie stanowi problemu. Ale jeśli potrzebujesz głęboką analizę, złożone architektury czy zaawansowaną logikę, modele open source mogą się nie sprawdzić.

Druga ograniczenie to wydajność sprzętu. Jeśli masz laptopa z 8GB RAM i procesorem z czterema rdzeniami, uruchamianie większych modeli będzie powolne. Billy.sh działa, ale nie tak szybko, jak chciałbyś. To jest naturalny trade-off między prywatnością a wydajnością — musisz mieć wystarczająco potężny sprzęt, aby uruchamiać modele lokalnie.

Trzecie ograniczenie to ekosystem. GitHub Copilot integruje się głęboko z VS Code, JetBrains IDEs i innymi edytorami. Billy.sh to terminal-native tool — działa doskonale w terminalu, ale jeśli spędzasz większość czasu w IDE, musisz przełączać się między narzędziami.

Konkurencja i pozycja na rynku

Rynek AI coding assistantów jest pełny. GitHub Copilot ma ogromny udział rynku dzięki integracji z VS Code i wsparciu Microsoftu. OpenAI ma ChatGPT Plus z Code Interpreter. Anthropic ma Claude z doskonałą obsługą kodu. Ale wszyscy oni działają w chmurze, wszyscy wymagają konta, wszyscy wysyłają twój kod na ich serwery.

Billy.sh ma inną niszę. Nie próbuje konkurować z siłą modeli czy szybkością. Konkuruje na podstawie prywatności, niezależności i kontroli. To jest segment rynku, który rośnie — coraz więcej firm, zwłaszcza w sektorze finansowym, ochrony zdrowia i bezpieczeństwa, szuka rozwiązań, które nie wysyłają danych do chmury.

Ale jest też kilka innych narzędzi w tej niszy. Continue.dev to open source IDE extension, który również używa lokalnych modeli. Codeium ma opcję self-hosted. Tabnine oferuje local deployment. Billy.sh musi się wyróżnić — i robi to poprzez prostotę, bundled Ollama i fokus na terminal-native experience.

Dla polskich deweloperów — praktyczne znaczenie

W Polsce rośnie świadomość kwestii prywatności i bezpieczeństwa danych. RODO nie jest już tylko słowem — to rzeczywistość, z którą firmy muszą się liczyć. Jeśli pracujesz dla polskiej firmy, która przetwarza dane osobowe, wysyłanie kodu do chmury może być problematyczne z punktu widzenia compliance'u. Billy.sh rozwiązuje ten problem.

Dodatkowo, polski rynek IT ma wiele małych i średnich firm, które nie mogą pozwolić sobie na GitHub Copilot Pro ($20/miesiąc) lub inne subskrypcje. Darmowa wersja Billy.sh z opcjonalnym jednorazowym upgradem za $19 jest znacznie bardziej przystępna cenowo. To może być rzeczywista alternatywa dla polskich startupów i freelancerów.

Trzecie, w Polsce jest silna społeczność open source i entuzjastów lokalnych rozwiązań. Billy.sh, będący oparty na open source Ollama i modelach open source, może znaleźć tam naturalną bazę użytkowników.

Przyszłość: Billy.sh w kontekście ewolucji AI

Billy.sh pojawia się w momencie, kiedy dyskusja o prywatności AI zaczyna być coraz głośniejsza. Europejskie regulacje, świadomość użytkowników, obawy przedsiębiorstw — wszystko to sprawia, że lokalne rozwiązania zyskują na znaczeniu. Nie jest to trend przejściowy, to fundamentalna zmiana w tym, jak myślimy o AI i danych.

Jeśli Billy.sh będzie się dobrze rozwijać, może to być początek większego trendu — przesunięcia od cloud-first AI assistantów do hybrid lub local-first rozwiązań. To nie oznacza, że GitHub Copilot czy ChatGPT znikną — będą one dalej dominować dla użytkowników, którzy nie martwią się prywatnością. Ale pojawi się coraz więcej opcji dla tych, którzy martwią się.

Ostatecznie, Billy.sh to symbol czegoś ważnego: oporu przeciwko centralizacji, dążenia do niezależności i pragnienia kontroli nad własnymi narzędziami. Może nie będzie to najbardziej zaawansowany AI assistant, ale może to być dokładnie ten, którego potrzebujesz.