Google: nowa kompresja TurboQuant obniża zużycie pamięci AI bez utraty jakości

Foto: Google

Osiem razy większa wydajność przy jednoczesnym sześciokrotnym zmniejszeniu zużycia pamięci – to wyniki, jakimi chwali się Google Research przy prezentacji TurboQuant. Nowy algorytm kompresji rozwiązuje jeden z najbardziej palących problemów generatywnej sztucznej inteligencji: ogromne zapotrzebowanie na zasoby sprzętowe, które winduje ceny podzespołów i ogranicza możliwości modeli. Kluczem do sukcesu jest optymalizacja tzw. key-value cache, czyli cyfrowej „ściągi”, w której Large Language Models przechowują przetworzone dane, by nie musieć obliczać ich od nowa. Przełom polega na zastosowaniu techniki PolarQuant, która zmienia sposób kodowania wektorów. Zamiast standardowych współrzędnych kartezjańskich, system konwertuje dane na współrzędne biegunowe, redukując je do zaledwie dwóch informacji: promienia oraz kierunku. Pozwala to na drastyczne obniżenie precyzji obliczeń (quantization) bez typowego dla tego procesu spadku jakości generowanych treści. Dla użytkowników końcowych oznacza to rewolucję w dostępności: zaawansowane modele AI będą mogły działać szybciej i sprawniej na słabszym sprzęcie, co znacząco obniży barierę wejścia dla twórców korzystających z lokalnych instancji LLM. TurboQuant udowadnia, że kluczem do skalowania AI nie musi być wyłącznie dokładanie kolejnych gigabajtów VRAM, ale inteligentniejsza matematyka stojąca za przetwarzaniem informacji.

W świecie generatywnej sztucznej inteligencji walka o zasoby sprzętowe stała się nową gorączką złota. Każdy, kto choć raz próbował uruchomić zaawansowany model językowy lokalnie lub zarządzać infrastrukturą serwerową, wie, że wąskim gardłem nie zawsze jest czysta moc obliczeniowa procesora, lecz drastyczne zapotrzebowanie na pamięć RAM i VRAM. Google Research zaprezentowało właśnie rozwiązanie, które może zmienić reguły gry w zakresie efektywności energetycznej i sprzętowej. TurboQuant, nowy algorytm kompresji, obiecuje radykalne zmniejszenie śladu pamięciowego modeli LLM przy jednoczesnym wzroście prędkości działania, co dotychczas niemal zawsze wiązało się z bolesnym kompromisem w jakości generowanych odpowiedzi.

Problem z nowoczesnymi modelami AI polega na tym, że ich "inteligencja" opiera się na matematycznej reprezentacji znaczeń w postaci wektorów. Te wysokowymiarowe struktury mogą zawierać setki, a nawet tysiące osadzeń (embeddings), opisujących wszystko — od niuansów semantycznych tekstu po skomplikowane dane wizualne. Przechowywanie tych informacji w czasie rzeczywistym, szczególnie w ramach tzw. key-value cache (pamięci podręcznej klucz-wartość), generuje ogromne obciążenie. Google trafnie porównuje ten mechanizm do "cyfrowej ściągi", która pozwala modelowi unikać ciągłego przeliczania tych samych danych, ale cena za tę wygodę jest mierzona w gigabajtach zajętej pamięci.

Koniec z dylematem precyzji i wydajności

Do tej pory standardowym podejściem do optymalizacji modeli była kwantyzacja. Polega ona na obniżeniu precyzji obliczeń, na przykład z 16-bitowych liczb zmiennoprzecinkowych do formatów 8-bitowych lub nawet 4-bitowych. Choć pozwala to na uruchomienie potężnych modeli na konsumenckim sprzęcie, niesie za sobą nieuniknioną degradację jakości. Model staje się mniej precyzyjny w przewidywaniu kolejnych tokenów, co w praktyce oznacza bardziej chaotyczne, mniej logiczne lub po prostu błędne odpowiedzi. TurboQuant ma ambicję przełamać ten schemat, oferując narzędzia, które pozwalają zachować ostrość "umysłu" AI przy znacznie niższym zapotrzebowaniu na zasoby.

Czytaj też

Wczesne wyniki testów przeprowadzonych przez inżynierów z Google są imponujące. W wybranych scenariuszach udało się uzyskać 8-krotny wzrost wydajności (performance increase) oraz 6-krotną redukcję zużycia pamięci. Co najważniejsze, parametry te osiągnięto bez mierzalnej utraty jakości wyjściowej. Oznacza to, że bariera wejścia dla zaawansowanych systemów AI może zostać przesunięta znacznie niżej, pozwalając na bardziej responsywne działanie asystentów na urządzeniach mobilnych czy w systemach brzegowych (edge computing), gdzie budżet pamięciowy jest zawsze rygorystycznie ograniczony.

PolarQuant: Innowacja w geometrii danych

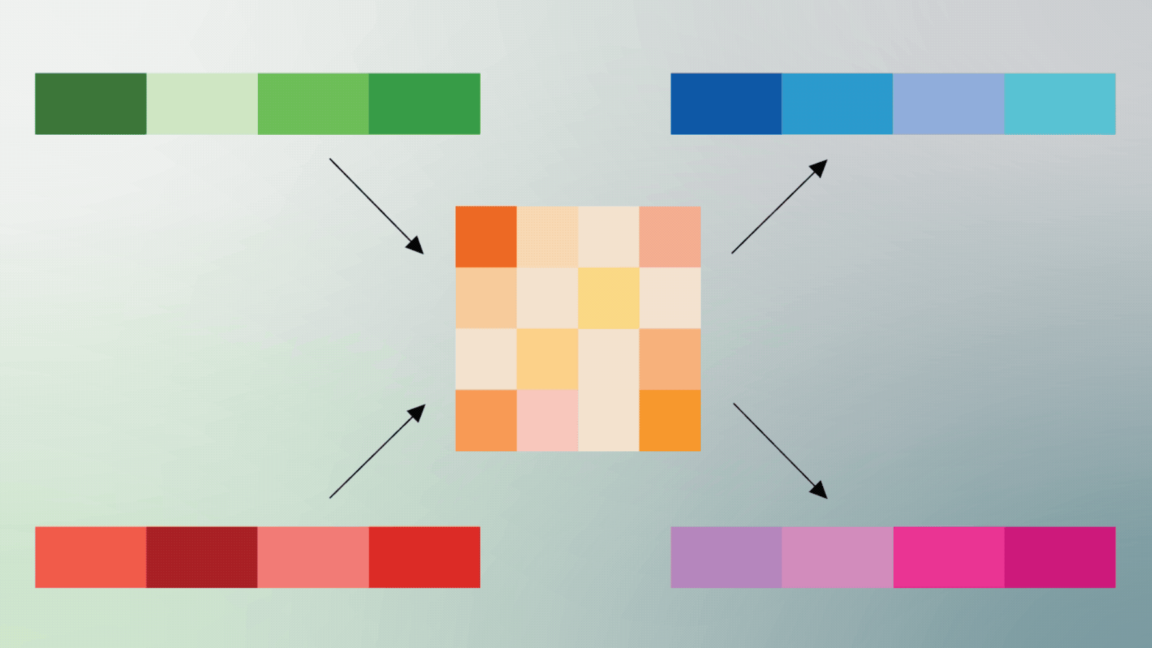

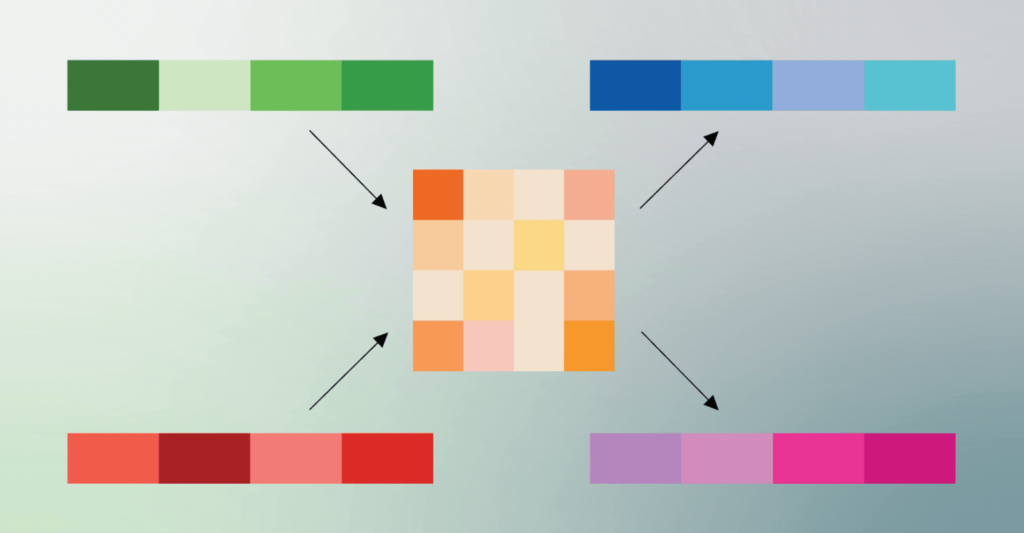

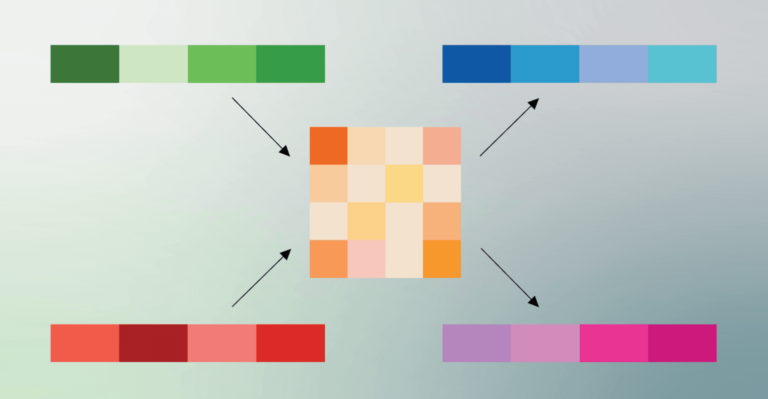

Kluczem do sukcesu TurboQuant jest dwuetapowy proces kompresji, w którym centralną rolę odgrywa system PolarQuant. Tradycyjnie wektory w modelach AI są kodowane przy użyciu standardowych współrzędnych kartezjańskich (system XYZ). Jest to rozwiązanie intuicyjne z matematycznego punktu widzenia, ale mało efektywne przy próbach agresywnej kompresji. Google zdecydowało się na radykalną zmianę perspektywy i konwersję wektorów na współrzędne biegunowe w ramach układu kartezjańskiego.

- Promień (Radius): Reprezentuje siłę rdzennych danych (core data strength).

- Kierunek (Direction): Odpowiada za semantyczne znaczenie informacji.

- Efektywność: Redukcja złożonych danych do dwóch kluczowych składowych na kolistym układzie współrzędnych.

Dzięki zastosowaniu siatki kołowej zamiast prostokątnej, PolarQuant jest w stanie znacznie precyzyjniej mapować istotne cechy danych przy użyciu mniejszej liczby bitów. To właśnie ta geometryczna innowacja pozwala na uniknięcie błędów typowych dla tradycyjnej kwantyzacji. Zamiast brutalnie ucinać precyzję każdej liczby, algorytm inteligentnie zarządza sposobem, w jaki reprezentowana jest informacja, skupiając się na tym, co dla modelu jest absolutnie kluczowe do zachowania spójności logicznej.

Nowa era dla lokalnych modeli językowych

Wprowadzenie TurboQuant może mieć kolosalne znaczenie dla branży półprzewodników i oprogramowania. Obecnie rynek pamięci RAM jest pod ogromną presją ze strony centrów danych budujących klastry pod AI, co przekłada się na wysokie ceny dla końcowych użytkowników. Jeśli technologia Google zostanie szeroko zaimplementowana, zapotrzebowanie na gigantyczne ilości pamięci w celu uruchomienia modeli o parametrach liczonych w setkach miliardów może spaść. To z kolei otwiera drzwi do prawdziwej demokratyzacji AI — technologia ta przestanie być domeną wyłącznie najpotężniejszych serwerowni.

"TurboQuant celuje w redukcję rozmiaru key-value cache, co bezpośrednio eliminuje wąskie gardła wydajnościowe w najpopularniejszych obecnie architekturach LLM."

Warto zwrócić uwagę na kontekst operacyjny: TurboQuant nie jest tylko teoretycznym modelem, ale praktycznym narzędziem mającym na celu optymalizację key-value cache. W miarę jak okna kontekstowe modeli (ilość tekstu, którą AI może "pamiętać" w jednej rozmowie) rosną, rozmiar tej pamięci podręcznej staje się krytycznym problemem. Dzięki 6-krotnej redukcji miejsca, deweloperzy będą mogli oferować znacznie dłuższe konwersacje i analizę obszerniejszych dokumentów bez konieczności inwestowania w nową infrastrukturę sprzętową.

Wdrożenie algorytmów takich jak TurboQuant zwiastuje zmianę paradygmatu w rozwoju sztucznej inteligencji. Przez ostatnie dwa lata obserwowaliśmy wyścig "na surową siłę" — więcej parametrów, więcej danych, więcej pamięci. Teraz branża wchodzi w fazę optymalizacji i elegancji inżynieryjnej. Możliwość uruchomienia modelu o klasie GPT-4 na sprzęcie, który wcześniej radził sobie ledwo z prostymi chatbotami, staje się realną perspektywą. Google, stawiając na innowacje w geometrii danych i precyzyjne zarządzanie pamięcią podręczną, wyznacza ścieżkę, którą prawdopodobnie podążą inni gracze, tacy jak OpenAI czy Anthropic, dążąc do stworzenia AI bardziej dostępnej i mniej zasobożernej.

Więcej z kategorii Sztuczna inteligencja

Szef Cisco, Chuck Robbins, chce budować centra danych w kosmosie

Jak korzystać z nowych integracji ChatGPT z DoorDash, Spotify, Uber i innymi aplikacjami

Hiszpański Xoople pozyskuje 130 mln dolarów w serii B na mapowanie Ziemi dla AI