Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

Foto: The Hacker News

Krytyczna podatność w popularnym narzędziu LiteLLM, służącym do ujednolicania API różnych modeli językowych, mogła zmienić stacje robocze deweloperów w otwarte skarbce z danymi uwierzytelniającymi. Jak wynika z raportu Zscaler ThreatLabz 2026 VPN Risk Report, błąd Server-Side Request Forgery (SSRF) pozwalał atakującym na zdalne przejęcie kluczy API do usług takich jak OpenAI, Anthropic czy Google Cloud Vertex AI. W dobie masowego wdrażania rozwiązań AI, gdzie deweloperzy operują na dziesiątkach wrażliwych tokenów, luka ta stała się najkrótszą drogą do pełnego naruszenia infrastruktury chmurowej organizacji. Raport podkreśla alarmujący trend: sztuczna inteligencja drastycznie skróciła czas reakcji człowieka na incydenty, czyniąc tradycyjne systemy VPN przestarzałymi i podatnymi na ataki typu lateral movement. Dla użytkowników i firm korzystających z bibliotek open-source do zarządzania LLM oznacza to konieczność natychmiastowej weryfikacji uprawnień sieciowych i przejścia na architekturę Zero Trust Exchange. Zamiast polegać na zabezpieczeniach obwodowych, zespoły kreatywne i techniczne muszą izolować procesy AI od reszty systemu, ponieważ jeden błąd w konfiguracji proxy może skutkować niekontrolowanym wyciekiem budżetu i danych treningowych do rąk cyberprzestępców. Bezpieczeństwo AI nie kończy się na samym modelu, lecz zaczyna od szczelności narzędzi, które go obsługują.

W dzisiejszym ekosystemie technologicznym to nie serwery produkcyjne, lecz stacje robocze programistów stały się najbardziej aktywnymi elementami infrastruktury korporacyjnej. Laptop dewelopera to miejsce, gdzie credentials są generowane, testowane, przechowywane w pamięci podręcznej i kopiowane między usługami, botami oraz narzędziami budowania. W marcu 2026 roku grupa hakerska TeamPCP udowodniła, że te maszyny stanowią obecnie najsłabsze ogniwo w łańcuchu dostaw, wykorzystując popularne narzędzie LiteLLM do przekształcenia komputerów osobistych w otwarte skarbce z danymi uwierzytelniającymi.

Atak przeprowadzony przez TeamPCP rzucił nowe światło na zagrożenia płynące z lokalnych agentów AI i narzędzi pośredniczących w dostępie do modeli językowych. Według najnowszego raportu Zscaler ThreatLabz 2026 VPN Risk Report, przygotowanego we współpracy z Cybersecurity Insiders, sztuczna inteligencja drastycznie skróciła czas reakcji człowieka na incydenty bezpieczeństwa. To, co kiedyś zajmowało napastnikom dni, teraz dzieje się w milisekundach, zamieniając zdalny dostęp w najszybszą ścieżkę do całkowitego przełamania zabezpieczeń organizacji.

Architektura podatności w ekosystemie AI

Narzędzie LiteLLM zyskało ogromną popularność dzięki uproszczeniu integracji z dziesiątkami różnych dostawców modeli AI poprzez ujednolicony format OpenAI. Jednak to, co miało być ułatwieniem dla programistów, stało się wektorem ataku typu supply chain. Deweloperzy, dążąc do maksymalnej wydajności, często przechowują klucze API do usług takich jak Anthropic, OpenAI czy Google Vertex AI bezpośrednio w zmiennych środowiskowych swoich lokalnych maszyn. TeamPCP precyzyjnie uderzyło w ten punkt styku, infekując zależności, od których zależały lokalne instancje agentów AI.

Czytaj też

Kiedy programista uruchamia lokalnego agenta AI, proces ten często posiada szerokie uprawnienia do odczytu plików konfiguracyjnych i pamięci podręcznej przeglądarki. Wykorzystując LiteLLM jako punkt wejścia, napastnicy byli w stanie nie tylko wykradać klucze API, ale również tokeny sesyjne VPN oraz poświadczenia do systemów CI/CD. Skala tego zjawiska pokazuje, że tradycyjne podejście do bezpieczeństwa punktów końcowych (endpoint security) jest całkowicie nieprzygotowane na dynamikę narzędzi napędzanych przez LLM.

- Klucze API w pamięci: Agenci AI często trzymają niezaszyfrowane dane uwierzytelniające w RAM, co ułatwia ich ekstrakcję.

- Zautomatyzowana eksfiltracja: Skrypty TeamPCP potrafiły w czasie rzeczywistym identyfikować najbardziej wartościowe tokeny i przesyłać je na serwery C2.

- Zaufanie do lokalnych procesów: Systemy EDR często ignorują aktywność narzędzi deweloperskich, uznając je za bezpieczne „środowiska pracy”.

Koniec ery bezpiecznego zdalnego dostępu

Analiza Zscaler ThreatLabz wskazuje na alarmujący trend: AI zlikwidowało margines błędu, który dotychczas pozwalał zespołom SOC (Security Operations Center) na skuteczną interwencję. W przypadku ataku na LiteLLM, proces infekcji i kradzieży tożsamości odbywał się niemal natychmiast po uruchomieniu zainfekowanego modułu. Tradycyjne rozwiązania VPN, zamiast chronić zasoby firmy, stały się autostradą dla napastników, którzy dysponując przejętymi poświadczeniami z maszyny dewelopera, logowali się do sieci jako autoryzowani użytkownicy.

Problem pogłębia fakt, że współczesne narzędzia AI wymagają do działania ogromnej liczby bibliotek zewnętrznych. Każda z nich to potencjalny punkt wejścia. TeamPCP nie musiało łamać skomplikowanych zapór ogniowych; wystarczyło, że ich złośliwy kod znalazł się w jednej z aktualizacji pomocniczych skryptów wykorzystywanych przez społeczność LiteLLM. To klasyczny przykład zatrucia studni, gdzie jeden zainfekowany element infekuje tysiące deweloperów na całym świecie.

Warto zwrócić uwagę na specyfikę pracy z local AI agents. Te autonomiczne programy mają za zadanie wykonywać operacje w imieniu użytkownika — pisać kod, wywoływać funkcje systemowe czy komunikować się z zewnętrznymi bazami danych. Jeśli taki agent zostanie skompromitowany u źródła (poprzez bibliotekę taką jak LiteLLM), staje się on idealnym „koniem trojańskim”, który ma już wszystkie niezbędne uprawnienia do poruszania się po infrastrukturze firmy.

Nowy paradygmat: Od zaufania do izolacji

Incydent z marca 2026 roku zmusza branżę do przedefiniowania pojęcia „bezpiecznej stacji roboczej”. Skoro deweloperzy muszą korzystać z narzędzi AI, a te z natury niosą ze sobą ryzyko supply chain attack, jedynym wyjściem wydaje się całkowita izolacja środowisk uruchomieniowych. Poleganie na tym, że programista samodzielnie zadba o bezpieczeństwo swoich credentials, okazało się strategią błędną i kosztowną.

"Laptop dewelopera przestał być narzędziem pracy, a stał się najcenniejszym celem strategicznym. Kto kontroluje środowisko Python na maszynie inżyniera, ten kontroluje klucze do królestwa całej korporacji."

Wnioski płynące z raportu Zscaler są jednoznaczne: organizacje muszą odejść od modelu opartego na VPN na rzecz architektury Zero Trust, która weryfikuje każdy proces, a nie tylko użytkownika. W świecie, gdzie AI potrafi w ułamku sekundy wykorzystać skradziony token, statyczne metody zabezpieczeń są bezużyteczne. Konieczne jest wdrożenie dynamicznych systemów monitorowania, które potrafią wykryć anomalie w zachowaniu narzędzi takich jak LiteLLM, zanim dane opuszczą lokalną maszynę.

Atak TeamPCP to dopiero początek nowej fali zagrożeń, w której AI nie jest tylko celem, ale i katalizatorem włamań. Deweloperzy, jako twórcy tych technologii, paradoksalnie stają się ich pierwszymi ofiarami, jeśli nie zmienią swoich nawyków dotyczących higieny cyfrowej i zarządzania sekretami. Era „zaufanych” maszyn lokalnych definitywnie dobiegła końca; przyszłość należy do mikro-segmentacji i pełnej izolacji procesów kreatywnych od krytycznych zasobów sieciowych.

Więcej z kategorii Bezpieczeństwo

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Microsoft ujawnia szczegóły ataków PHP Web Shell na serwerach Linux sterowanych przez Cookie

Podobne artykuły

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

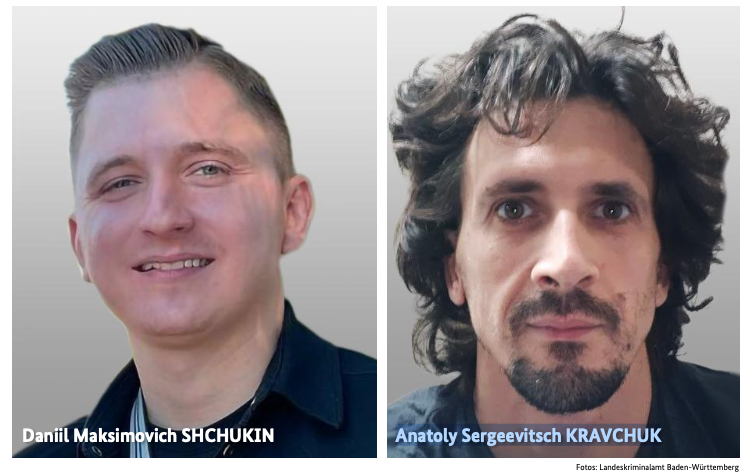

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi

Niemcy ujawniają tożsamość „UNKN”, lidera grup ransomware REvil i GandCrab

6 kwi