OpenAI wprowadza wtyczki do Codex, goniąc możliwości oferowane przez Claude Code

Foto: Samuel Axon

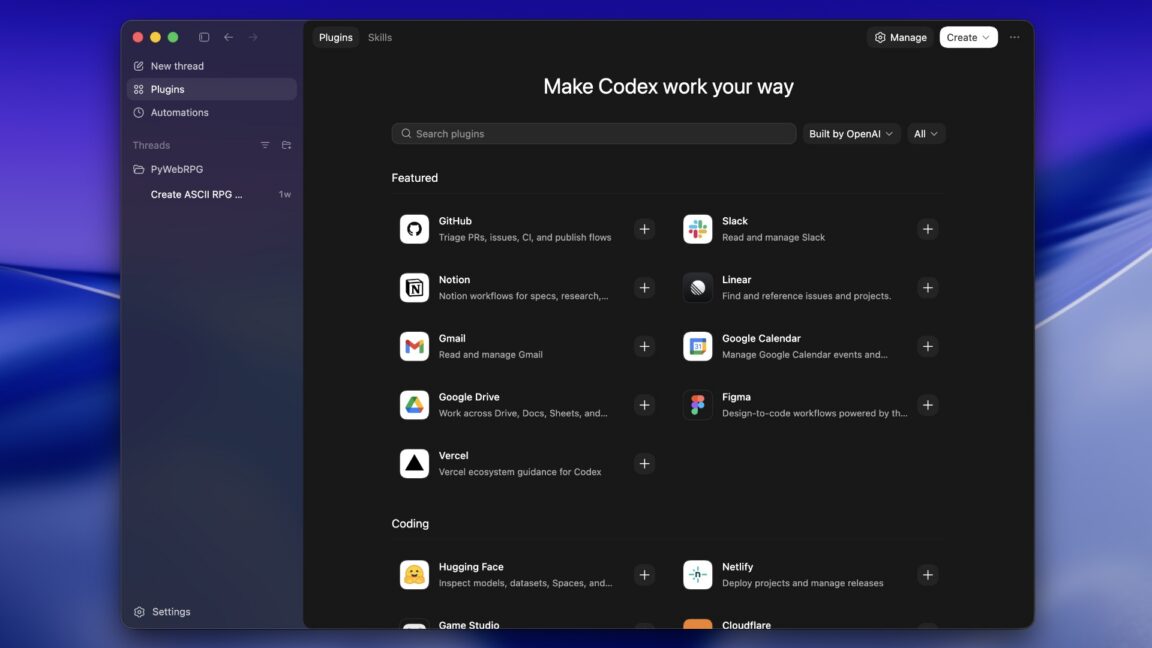

Jedno kliknięcie dzieli teraz użytkowników Codex od pełnej integracji z GitHubem, Gmailem czy Cloudflare, co stanowi bezpośrednią odpowiedź OpenAI na rosnącą dominację Claude Code oraz interfejsu CLI od Google Gemini. Wprowadzenie sekcji Plugins do tej agentycznej aplikacji kodującej to strategiczny ruch mający na celu uproszczenie złożonych workflowów, które do tej pory wymagały od programistów ręcznej konfiguracji Model Context Protocol (MCP) oraz żmudnego definiowania instrukcji niestandardowych. Nowe wtyczki to w rzeczywistości gotowe pakiety łączące umiejętności (skille), integracje z aplikacjami zewnętrznymi oraz serwery MCP. Choć technicznie nie wprowadzają one funkcji niemożliwych do osiągnięcia wcześniej przez zaawansowanych użytkowników, ich rynkowa wartość tkwi w demokratyzacji dostępu do zaawansowanej automatyzacji. Dzięki przeszukiwalnej bibliotece, zespoły programistyczne mogą teraz błyskawicznie replikować specyficzne konfiguracje i workflowy wewnątrz całej organizacji, co znacząco redukuje czas potrzebny na setup środowiska pracy. Dla globalnej społeczności twórców oznacza to przejście od etapu ręcznego "sklejania" narzędzi AI do ery modularnych, gotowych do użycia ekosystemów, gdzie spójność narzędziowa między platformami takimi jak Vercel czy Box staje się standardem, a nie przywilejem nielicznych ekspertów. Wyścig o miano najbardziej efektywnego asystenta kodowania wchodzi tym samym w fazę walki o wygodę i szybkość wdrożenia, a nie tylko o samą moc obliczeniową modeli.

Wyścig zbrojeniowy w segmencie narzędzi programistycznych napędzanych przez AI nabiera tempa, a OpenAI właśnie wykonało ruch, który ma na celu zniwelowanie dystansu do najgroźniejszych rywali. Firma ogłosiła wprowadzenie wsparcia dla wtyczek (plugins) do swojej agentycznej aplikacji kodującej Codex. Choć na pierwszy rzut oka może się to wydawać jedynie kosmetyczną zmianą w interfejsie, w rzeczywistości jest to bezpośrednia odpowiedź na funkcjonalności, które od pewnego czasu oferują już Anthropic w ramach Claude Code oraz Google w interfejsie wiersza poleceń Gemini.

Wprowadzenie wtyczek to sygnał, że rynek narzędzi typu "agentic coding" dojrzewa. Deweloperzy nie szukają już tylko generycznego czatu, który potrafi napisać prostą funkcję w Pythonie. Oczekują ekosystemu, który rozumie ich specyficzny workflow, integruje się z używanymi przez nich usługami chmurowymi i pozwala na automatyzację złożonych procesów bez konieczności ręcznego konfigurowania każdego zapytania. OpenAI, wprowadzając ten update, przyznaje, że wygoda użytkowania (UX) staje się równie ważna, co potęga samego modelu językowego.

Architektura wtyczek i Model Context Protocol

To, co OpenAI nazywa "wtyczkami", to w rzeczywistości kompleksowe pakiety (bundles), które wykraczają poza proste rozszerzenia znane z przeglądarek. W skład pojedynczej wtyczki wchodzą trzy kluczowe komponenty: umiejętności (skills), integracje z aplikacjami oraz serwery MCP (Model Context Protocol). Umiejętności są definiowane jako zestaw promptów opisujących konkretne przepływy pracy, co pozwala Codex na realizację wieloetapowych zadań zgodnie z wytycznymi organizacji.

Czytaj też

Kluczowym elementem tej układanki jest wsparcie dla Model Context Protocol. MCP to otwarty standard, który umożliwia modelom AI bezpieczny i ustrukturyzowany dostęp do danych z zewnętrznych systemów. Dzięki temu Codex może nie tylko generować kod, ale również "rozmawiać" z bazami danych, systemami plików czy API w sposób ujednolicony. Integracja ta sprawia, że narzędzie staje się bardziej świadome kontekstu, w jakim pracuje programista, co drastycznie redukuje liczbę błędów wynikających z braku wiedzy o infrastrukturze projektu.

- Skills: Predefiniowane workflowy ułatwiające powtarzalne zadania deweloperskie.

- App Integrations: Bezpośrednie połączenia z zewnętrznymi ekosystemami.

- MCP Servers: Standardowa komunikacja z zewnętrznymi źródłami danych i narzędziami lokalnymi.

- Searchable Library: Centralne repozytorium ułatwiające odkrywanie nowych funkcjonalności.

Dostępność dla mas kontra potrzeby Power Userów

Analizując tę nowość, należy uczciwie przyznać: OpenAI nie wymyśliło koła na nowo pod względem technicznym. Zaawansowani użytkownicy, czyli tzw. "power users", już wcześniej potrafili uzyskać podobne rezultaty. Wykorzystywali do tego niestandardowe instrukcje (custom instructions), własnoręcznie konfigurowane serwery MCP oraz zewnętrzne skrypty integrujące Codex z innymi narzędziami. Różnica polega jednak na demokratyzacji tych rozwiązań.

Obecnie konfiguracja, która wcześniej wymagała czasu i technicznego zacięcia, sprowadza się do "instalacji jednym kliknięciem". To strategiczne posunięcie ma na celu przyciągnięcie do Codex mniej technicznych członków zespołów oraz przyspieszenie onboardingu w dużych organizacjach. Możliwość replikowania tych samych ustawień i zestawów narzędzi pomiędzy wieloma użytkownikami w firmie to ogromna zaleta z punktu widzenia zarządzania procesami IT i standaryzacji pracy z AI.

Ekosystem integracji: GitHub, Cloudflare i Vercel

Wewnątrz aplikacji Codex pojawiła się dedykowana sekcja Plugins, która pełni rolę swoistego marketplace'u. Użytkownicy mogą tam przeszukiwać bibliotekę rozszerzeń zaprojektowanych do ścisłej współpracy z najpopularniejszymi usługami w branży tech. Na liście startowej znalazły się takie potęgi jak GitHub, Gmail, Box, Cloudflare oraz Vercel. Każda z tych wtyczek ma na celu wyeliminowanie konieczności przełączania się między oknami przeglądarki.

Dla przykładu, integracja z Vercel lub Cloudflare pozwala Codex na bezpośrednie zarządzanie procesami wdrożeniowymi (deployment) lub edycję konfiguracji sieciowej bez opuszczania środowiska kodowania. Z kolei wtyczka GitHub umożliwia głębszą analizę repozytoriów i zarządzanie zgłoszeniami (issues) bezpośrednio przez agenta AI. To podejście sprawia, że Codex przestaje być tylko edytorem tekstu z funkcją autouzupełniania, a staje się centralnym hubem operacyjnym programisty.

Wprowadzenie wtyczek to nie tylko doganianie konkurencji, to przede wszystkim próba stworzenia standardu "one-click" w świecie, gdzie konfiguracja narzędzi AI stawała się zbyt skomplikowana dla przeciętnego użytkownika.

Perspektywa Pixelift na tę zmianę jest jasna: OpenAI zrozumiało, że w świecie AI hardware i surowa moc obliczeniowa to tylko połowa sukcesu. Druga połowa to ekosystem. Choć Anthropic ze swoim Claude Code narzucił wysokie tempo w kwestii interakcji z kodem, OpenAI stawia na szerokość integracji. Wykorzystanie Model Context Protocol sugeruje, że firma nie chce zamykać użytkowników w złotej klatce, ale dąży do bycia najbardziej kompatybilnym narzędziem na rynku. W dłuższej perspektywie wygra ten dostawca, którego agent AI będzie miał najmniej "tarcia" podczas kontaktu z realnymi narzędziami pracy dewelopera.

Więcej z kategorii Sztuczna inteligencja

Szef Cisco, Chuck Robbins, chce budować centra danych w kosmosie

Jak korzystać z nowych integracji ChatGPT z DoorDash, Spotify, Uber i innymi aplikacjami

Hiszpański Xoople pozyskuje 130 mln dolarów w serii B na mapowanie Ziemi dla AI