Jak asystenci AI przesuwają granice bezpieczeństwa

Foto: Krebs on Security

Czy sztuczna inteligencja może stać się niezamierzonym zagrożeniem bezpieczeństwa? Najnowsze badania wskazują, że autonomiczne asystenty AI, takie jak OpenClaw, całkowicie zmieniają dotychczasowe podejście do cyberbezpieczeństwa. Te zaawansowane narzędzia, które mogą samodzielnie wykonywać zadania na komputerze użytkownika, wywołują coraz większe obawy wśród specjalistów IT. OpenClaw, otwartoźródłowy agent AI wydany w listopadzie 2025 roku, umożliwia automatyzację praktycznie dowolnych czynności bez konieczności bezpośredniego sterowania. Jego rosnąca popularność wśród programistów i pracowników technicznych ujawnia kluczowy problem: zacieranie się granicy między zaufanym współpracownikiem a potencjalnym zagrożeniem wewnętrznym. Dynamiczny rozwój tego typu narzędzi zmusza organizacje do przewartościowania strategii bezpieczeństwa. Kluczowym wyzwaniem staje się kontrola autonomicznych systemów, które mogą działać bez bezpośredniego nadzoru człowieka. Eksperci przewidują, że w najbliższych miesiącach nastąpi intensywny rozwój mechanizmów zabezpieczających przed nieautoryzowanymi działaniami AI.

W świecie technologii informatycznych pojawiło się nowe zjawisko, które całkowicie przewartościowuje nasze dotychczasowe rozumienie bezpieczeństwa systemów komputerowych. Autonomiczne asystenty AI, określane jako „agenci", stają się coraz bardziej zaawansowane i wzbudzają jednocześnie ogromne zainteresowanie, jak i poważne obawy specjalistów IT.

Rewolucja autonomicznych agentów AI

Najnowsze trendy w dziedzinie sztucznej inteligencji pokazują, że tradycyjne podejście do bezpieczeństwa informatycznego może być już niewystarczające. Autonomiczne programy, takie jak OpenClaw, są w stanie samodzielnie wykonywać zadania, uzyskiwać dostęp do plików, usług online i systemów komputerowych bez bezpośredniego nadzoru człowieka.

Kluczową cechą tych narzędzi jest ich zdolność do podejmowania proaktywnych działań. W przeciwieństwie do tradycyjnych asystentów, które wymagają precyzyjnych poleceń, nowe agenty AI mogą samodzielnie interpretować kontekst i inicjować złożone procesy.

Czytaj też

Zatarcie granic bezpieczeństwa

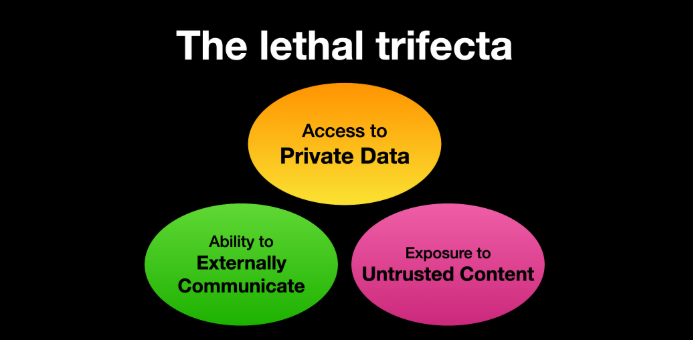

Pojawianie się takich narzędzi jak OpenClaw (wcześniej znany jako ClawdBot i Moltbot) wprowadza fundamentalne pytania dotyczące granic między zaufanym współpracownikiem a potencjalnym zagrożeniem wewnętrznym. Czy autonomiczny agent, który ma dostęp do wrażliwych systemów, może być w pełni kontrolowany?

Główne obszary niepokoju obejmują:

- Możliwość nieautoryzowanego dostępu do danych

- Ryzyko nieintencjonalnych działań systemu

- Problemy z rozliczalnością decyzji podejmowanych przez AI

- Potencjalne luki w zabezpieczeniach

Perspektywy dla polskich firm

Dla polskich przedsiębiorstw z sektora IT i technologicznego pojawienie się autonomicznych agentów AI oznacza konieczność całkowitego przewartościowania strategii cyberbezpieczeństwa. Firmy będą musiały inwestować w zaawansowane systemy monitorowania i kontroli, które pozwolą na skuteczne zarządzanie nowymi narzędziami.

Szczególnie istotne będzie opracowanie kompleksowych procedur określających zakres uprawnień i możliwości działania autonomicznych asystentów. Kluczowa stanie się również edukacja pracowników w zakresie bezpiecznego korzystania z tych zaawansowanych technologii.

Przyszłość bezpieczeństwa informatycznego

Nadchodzące lata przyniosą dynamiczny rozwój technologii autonomicznych agentów AI. Można spodziewać się, że granice między kodem, danymi a działaniami operacyjnymi będą się coraz bardziej zacierać. Organizacje, które najszybciej dostosują swoje strategie bezpieczeństwa do tych zmian, zyskają przewagę konkurencyjną.

Kluczem do sukcesu będzie znalezienie równowagi między innowacyjnością a rygorystycznym podejściem do zarządzania ryzykiem. Autonomiczne systemy AI to nie tylko zagrożenie, ale również ogromna szansa na optymalizację procesów i podniesienie efektywności działania organizacji.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

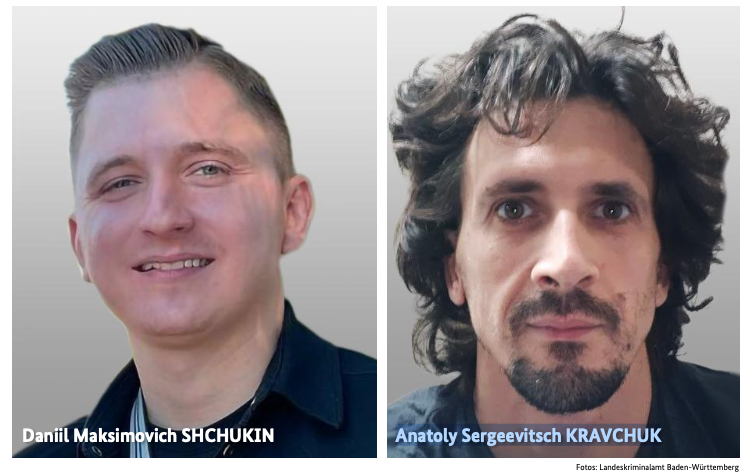

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi