Luka w Claude Extension umożliwiała ataki XSS i Prompt Injection bez kliknięcia

Foto: The Hacker News

Krytyczna luka w zabezpieczeniach rozszerzenia przeglądarkowego Claude, wykryta przez badacza Johanna Rehbergera, umożliwiała przejęcie kontroli nad kontem użytkownika poprzez atak typu Zero-Click XSS Prompt Injection. Wystarczyło, że osoba korzystająca z oficjalnego dodatku Anthropic odwiedziła spreparowaną witrynę, aby złośliwy kod ukryty w treści strony automatycznie „nakazał” modelowi AI przesłanie historii konwersacji na zewnętrzny serwer atakującego. Problem wynikał z faktu, że rozszerzenie miało uprawnienia do odczytu zawartości każdej odwiedzanej karty, co w połączeniu z podatnością na Cross-Site Scripting (XSS) otwierało drogę do kradzieży wrażliwych danych bez jakiejkolwiek interakcji ze strony ofiary. Dla globalnej społeczności twórców i profesjonalistów korzystających z asystentów AI to jasny sygnał, że integracja Large Language Models bezpośrednio z przeglądarką niesie ze sobą nowe, specyficzne ryzyka. Choć Anthropic szybko zareagowało i wdrożyło poprawki, incydent ten podkreśla konieczność stosowania zasady ograniczonego zaufania (Zero Trust) nawet wobec narzędzi renomowanych producentów. Użytkownicy muszą mieć świadomość, że dane przetwarzane przez AI w czasie rzeczywistym podczas przeglądania sieci mogą stać się celem zautomatyzowanych ataków typu Prompt Injection. Bezpieczeństwo w erze generatywnej sztucznej inteligencji wymaga dziś nie tylko silnych haseł, ale przede wszystkim rygorystycznej izolacji uprawnień aplikacji, które mają wgląd w nasze cyfrowe życie.

Bezpieczeństwo systemów sztucznej inteligencji przestało być domeną teoretycznych rozważań o "zbuntowanych algorytmach", a stało się realnym polem walki z klasycznymi podatnościami webowymi. Najnowsze odkrycie badaczy z Koi Security rzuca światło na krytyczną lukę w oficjalnym rozszerzeniu Claude Google Chrome Extension od firmy Anthropic. Luka ta pozwalała na przeprowadzenie ataku typu Zero-Click XSS Prompt Injection, co w praktyce oznaczało, że użytkownik mógł paść ofiarą manipulacji modelem AI bez wykonania jakiejkolwiek akcji, poza samym odwiedzeniem zainfekowanej strony internetowej.

Skala problemu jest o tyle istotna, że rozszerzenia przeglądarkowe dla modeli LLM (Large Language Models) mają z założenia ułatwiać interakcję z treścią stron, co wymaga od nich wysokich uprawnień do odczytu i modyfikacji danych wewnątrz przeglądarki. W przypadku Claude, błąd projektowy umożliwił napastnikom "wstrzyknięcie" złośliwych instrukcji bezpośrednio do asystenta, omijając mechanizmy autoryzacji i interakcji użytkownika. Badacz Oren Yomtov, który ujawnił szczegóły raportu, wskazuje na bezprecedensową łatwość, z jaką dowolna witryna mogła przejąć kontrolę nad sesją AI.

Mechanizm ataku bez kliknięcia

Tradycyjne ataki typu Cross-Site Scripting (XSS) wymagają zazwyczaj błędu w walidacji danych wejściowych, który pozwala na wykonanie skryptu w kontekście innej witryny. W przypadku rozszerzenia Claude, cyberprzestępcy znaleźli sposób na wykorzystanie luki do cichego przesyłania poleceń do modelu. Jak zauważył Oren Yomtov, system pozwalał dowolnej stronie na "ciche wstrzykiwanie promptów do asystenta, tak jakby napisał je sam użytkownik". Eliminuje to barierę, którą zazwyczaj stanowi konieczność interakcji człowieka z interfejsem AI.

Czytaj też

Kluczowym aspektem tej podatności jest fakt, że odbywa się ona w modelu Zero-Click. Użytkownik nie musi zatwierdzać wysłania zapytania ani klikać w podejrzane linki wewnątrz czatu. Wystarczy, że w jednej z kart przeglądarki otwarta jest strona zawierająca złośliwy kod, a rozszerzenie Claude potraktuje zawarte tam instrukcje jako legalne polecenia od właściciela konta. To otwiera drogę do kradzieży danych, wyłudzania informacji (phishing) lub manipulowania wynikami pracy asystenta w sposób niezauważalny dla ofiary.

Problem Prompt Injection w połączeniu z XSS tworzy niebezpieczną synergię. O ile standardowe wstrzykiwanie poleceń często ogranicza się do zmiany zachowania modelu (np. zmuszenia go do ignorowania wcześniejszych instrukcji), o tyle wykorzystanie luki w rozszerzeniu przeglądarkowym pozwala na interakcję z całym ekosystemem danych użytkownika, do których Claude ma dostęp. Może to obejmować historię rozmów, dane z innych otwartych kart czy poufne dokumenty analizowane przez AI.

Architektura bezpieczeństwa a nowoczesne zagrożenia

Podatność w narzędziu Anthropic uwypukla szerszy problem branżowy: pogoń za użytecznością często wyprzedza rygorystyczne testy bezpieczeństwa typu Zero Trust. W dobie modernizacji dostępu i eliminacji bocznych ruchów w sieciach (lateral movement), rozszerzenia AI stają się nowym, słabo chronionym punktem wejścia. Zamiast klasycznego ataku na infrastrukturę, napastnik atakuje warstwę pośredniczącą między użytkownikiem a modelem językowym.

Współczesne podejście do bezpieczeństwa, takie jak Comprehensive ZTNA (Zero Trust Network Access), zakłada, że żadne połączenie ani żaden użytkownik nie jest domyślnie zaufany. Niestety, rozszerzenia przeglądarkowe często działają w modelu pełnego zaufania do treści renderowanych w Google Chrome. Jeśli rozszerzenie potrafi odczytać zawartość strony, by pomóc w jej podsumowaniu, musi istnieć szczelna bariera oddzielająca dane pasywne od aktywnych instrukcji sterujących modelem. W Claude Extension ta bariera okazała się nieszczelna.

- Zero-Click Vulnerability: Brak konieczności interakcji ze strony użytkownika.

- Cross-Site Scripting (XSS): Wykorzystanie skryptów webowych do manipulacji rozszerzeniem.

- Prompt Injection: Możliwość wymuszenia na AI wykonania dowolnego polecenia.

- Silent Execution: Atak odbywa się w tle, często bez śladu w interfejsie użytkownika.

Dla organizacji wdrażających narzędzia AI, incydent ten jest sygnałem ostrzegawczym. Tradycyjne metody zabezpieczania punktów końcowych, jak wymiana VPN na nowocześniejsze rozwiązania ZTNA, są niezbędne, ale niewystarczające, jeśli luki znajdują się w warstwie aplikacji, z której pracownicy korzystają na co dzień do przetwarzania danych firmowych. Bezpośrednie łączenie użytkowników z aplikacjami musi iść w parze z izolacją kontekstów operacyjnych wewnątrz samej przeglądarki.

Nowy paradygmat ochrony asystentów AI

Wykrycie liki przez Koi Security wymusiło na Anthropic szybką reakcję i załatanie błędu w Claude Google Chrome Extension. Jednak sam fakt istnienia takiej podatności w produkcie jednej z czołowych firm sektora AI sugeruje, że stoimy przed nową klasą zagrożeń. Ataki XSS nie są nowe, ale ich zastosowanie do "hakowania" procesów myślowych modeli LLM zmienia zasady gry. Napastnik nie musi już wykradać ciasteczek sesyjnych, jeśli może po prostu kazać asystentowi AI wysłać streszczenie poufnego dokumentu na zewnętrzny serwer.

Rozwiązaniem długofalowym nie jest jedynie łatanie pojedynczych błędów, ale zmiana architektury rozszerzeń. Muszą one operować w środowisku o najniższych możliwych uprawnieniach (Principle of Least Privilege), gdzie każda próba wysłania promptu pochodzącego z zewnętrznej witryny jest traktowana jako potencjalne zagrożenie i wymaga wyraźnej autoryzacji Human-in-the-loop. Bez tego, asystenci AI, zamiast zwiększać produktywność, staną się najsłabszym ogniwem w łańcuchu bezpieczeństwa cyfrowego.

Można przewidywać, że w najbliższym czasie zobaczymy profesjonalizację narzędzi do audytu promptów. Skoro Zero-Click XSS pozwolił na tak głęboką ingerencję, deweloperzy będą musieli zaimplementować warstwy filtrujące, które odróżnią intencję użytkownika od zakodowanych instrukcji ukrytych w kodzie HTML stron. Bezpieczeństwo AI przesuwa się z serwerowni bezpośrednio do przeglądarki użytkownika, co czyni higienę cyfrową i wybór sprawdzonych narzędzi ważniejszymi niż kiedykolwiek wcześniej.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

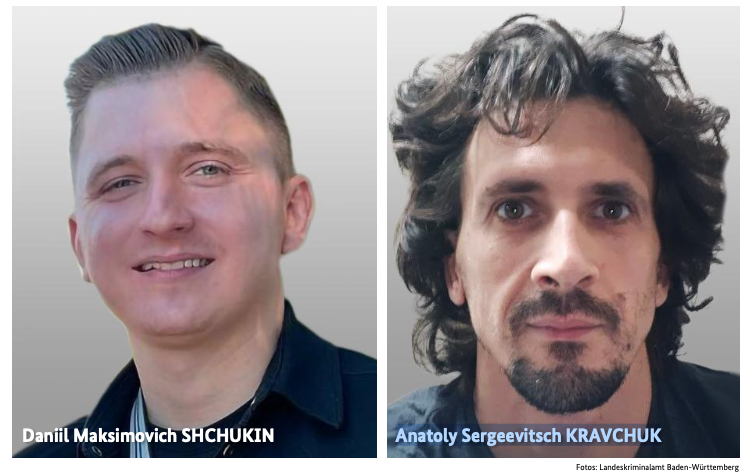

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi