Luka w Vertex AI naraża dane Google Cloud i prywatne artefakty na ryzyko

Foto: The Hacker News

Krytyczna luka w zabezpieczeniach platformy Vertex AI pozwoliła badaczom z Orca Security na uzyskanie nieautoryzowanego dostępu do prywatnych danych w Google Cloud, w tym do modeli machine learning oraz poufnych artefaktów. Wykorzystując błąd eskalacji uprawnień związany z usługą Custom Jobs, specjaliści byli w stanie odczytać pliki z Cloud Storage oraz pobrać obrazy z Artifact Registry innych użytkowników. Problem wynikał z niewłaściwej konfiguracji uprawnień domyślnego konta serwisowego, co w praktyce umożliwiało atakującym poruszanie się lateralne wewnątrz infrastruktury chmurowej. Dla globalnej społeczności twórców i inżynierów AI incydent ten jest sygnałem alarmowym dotyczącym bezpieczeństwa modeli typu black-box. Praktyczne implikacje są jasne: poleganie wyłącznie na domyślnych zabezpieczeniach dostawców chmury bywa ryzykowne, zwłaszcza w dobie masowego wdrażania generatywnej sztucznej inteligencji. Choć Google załatało już tę konkretną lukę, użytkownicy powinni niezwłocznie przejść na model Zero Trust oraz zasadę Least Privilege (PoL), samodzielnie ograniczając uprawnienia kont serwisowych. Ochrona własności intelektualnej w chmurze wymaga dziś od deweloperów aktywnego audytu uprawnień, ponieważ pojedynczy błąd w konfiguracji platformy AI może wystawić na widok publiczny lata pracy nad autorskimi algorytmami.

W świecie, w którym sztuczna inteligencja staje się fundamentem operacyjnym nowoczesnych przedsiębiorstw, bezpieczeństwo platform przetwarzających te dane staje się priorytetem najwyższej rangi. Badacze z zespołu Palo Alto Networks Unit 42 ujawnili krytyczną lukę w zabezpieczeniach platformy Vertex AI należącej do Google Cloud. Odkryta podatność, określana mianem "martwego pola" (security blind spot), rzuca nowe światło na ryzyka związane z implementacją agentów AI w środowiskach chmurowych.

Problem nie wynika z błędu w kodzie samym w sobie, lecz z fundamentalnego sposobu, w jaki skonstruowany został model uprawnień wewnątrz Vertex AI. Wykorzystanie tej luki pozwala potencjalnemu napastnikowi na uzbrojenie agentów AI w taki sposób, aby uzyskały one nieautoryzowany dostęp do wrażliwych danych organizacji. W najgorszym scenariuszu może to doprowadzić do całkowitego przejęcia prywatnych artefaktów i kompromitacji całego ekosystemu chmurowego firmy, co w dobie rygorystycznych przepisów o ochronie danych stanowi scenariusz katastrofalny.

Mechanizm nadużycia modelu uprawnień Vertex AI

Kluczem do zrozumienia zagrożenia jest specyfika działania agentów AI, którzy operują na szerokich uprawnieniach w celu sprawnego przetwarzania zapytań i interakcji z różnymi usługami Google Cloud. Według raportu Unit 42, napastnik może zmanipulować procesy decyzyjne agenta, zmuszając go do wyjścia poza zdefiniowany zakres obowiązków. Wykorzystując luki w konfiguracji uprawnień, zewnętrzny podmiot jest w stanie skłonić system do eksfiltracji danych, do których teoretycznie nie powinien mieć dostępu nikt poza wąską grupą administratorów.

Czytaj też

Najbardziej niepokojącym aspektem tego odkrycia jest fakt, że tradycyjne narzędzia monitorujące mogą nie wykryć tego typu aktywności. Ponieważ operacje są wykonywane przez autoryzowane instancje Vertex AI, systemy bezpieczeństwa często klasyfikują je jako legalny ruch wewnątrz infrastruktury. To właśnie ta niewidoczność sprawia, że badacze mówią o "martwym polu" – miejscu, gdzie standardowe polityki bezpieczeństwa przestają działać, a kontrolę przejmuje logika modelu AI, którą można relatywnie łatwo nagiąć do celów przestępczych.

W praktyce oznacza to, że prywatne artefakty, takie jak modele uczenia maszynowego, zestawy danych treningowych czy klucze API przechowywane wewnątrz Google Cloud, stają się podatne na kradzież. Dla firm technologicznych, których wartość opiera się na własności intelektualnej zawartej w algorytmach, taka ekspozycja danych stanowi egzystencjalne zagrożenie. Palo Alto Networks podkreśla, że bez dogłębnej rewizji sposobu, w jaki agenci AI wchodzą w interakcję z zasobami chmurowymi, podobne incydenty będą się powtarzać.

Ewolucja dostępu: od VPN do Zero Trust Network Access

Odkryta podatność w Vertex AI wpisuje się w szerszy trend konieczności modernizacji dostępu do zasobów cyfrowych. Tradycyjne rozwiązania, takie jak VPN, stają się niewystarczające w obliczu tak zaawansowanych zagrożeń wewnętrznych i bocznych (lateral movement). Zamiast polegać na weryfikacji tożsamości tylko na "wejściu" do sieci, nowoczesne organizacje muszą wdrażać kompleksowe podejście Zero Trust Network Access (ZTNA), które eliminuje zaufanie domyślne nawet dla procesów zachodzących wewnątrz chmury.

- Eliminacja ruchu bocznego: ZTNA łączy użytkowników i procesy AI bezpośrednio z aplikacjami, a nie z całą siecią, co ogranicza pole manewru napastnika po przejęciu jednego elementu.

- Granularna kontrola uprawnień: Każda interakcja agenta AI z danymi w Google Cloud powinna być weryfikowana pod kątem minimalnych niezbędnych uprawnień (Principle of Least Privilege).

- Ciągłe monitorowanie kontekstowe: Systemy bezpieczeństwa muszą analizować nie tylko to, "kto" ma dostęp, ale "w jaki sposób" i "w jakim celu" dane są przetwarzane przez modele Vertex AI.

Przejście z modelu opartego na VPN na pełne ZTNA pozwala na stworzenie bezpieczniejszego środowiska dla rozwoju sztucznej inteligencji. W kontekście Vertex AI, oznacza to konieczność odizolowania agentów od krytycznych zasobów, które nie są niezbędne do ich funkcjonowania. Bez takiej separacji, nawet najbardziej zaawansowane mechanizmy obronne Google Cloud mogą zostać ominięte przez kreatywne wykorzystanie uprawnień systemowych.

Architektura bezpieczeństwa w dobie autonomicznych agentów

Analiza Palo Alto Networks Unit 42 sugeruje, że problem z Vertex AI jest jedynie wierzchołkiem góry lodowej. W miarę jak agenci AI stają się bardziej autonomiczni, ich zdolność do wykonywania akcji w imieniu użytkownika rośnie, a wraz z nią rośnie ryzyko nadużyć. Model bezpieczeństwa chmury musi ewoluować w stronę dynamicznego zarządzania tożsamością maszynową. Obecnie wiele organizacji popełnia błąd, traktując agentów AI jako statyczne narzędzia, podczas gdy w rzeczywistości są to dynamiczne byty operacyjne o szerokich możliwościach modyfikacji swojego zachowania.

"Bezpieczeństwo AI to nie tylko ochrona modelu przed atakami typu adversarial, to przede wszystkim zabezpieczenie infrastruktury, na której te modele operują." – wskazują eksperci branżowi, komentując sprawę Vertex AI.

Konieczne jest wprowadzenie warstwy pośredniczącej, która będzie audytować zapytania generowane przez agentów Vertex AI przed ich wykonaniem w środowisku produkcyjnym. Tego typu "strażnicy" (guardrails) mogą blokować próby dostępu do wrażliwych artefaktów, nawet jeśli uprawnienia systemowe teoretycznie na to pozwalają. Jest to podejście niezbędne, by zamknąć "martwe pola" zidentyfikowane przez badaczy bezpieczeństwa.

Nowy standard ochrony zasobów AI

Incydent z Vertex AI powinien być sygnałem ostrzegawczym dla wszystkich dyrektorów ds. bezpieczeństwa informacji (CISO). Bezpieczna implementacja sztucznej inteligencji wymaga czegoś więcej niż tylko wyboru renomowanego dostawcy chmury. Wymaga ona aktywnego audytu konfiguracji IAM (Identity and Access Management) oraz zrozumienia, że każda nowa funkcja AI wprowadza unikalny wektor ataku. Google Cloud regularnie aktualizuje swoje systemy, jednak odpowiedzialność za właściwą konfigurację i ograniczenie uprawnień spoczywa w dużej mierze na końcowym użytkowniku.

W mojej ocenie, stoimy u progu nowej ery cyberbezpieczeństwa, w której walka będzie toczyć się o integralność logiki agentów AI. Jeśli nie nauczymy się skutecznie izolować procesów decyzyjnych sztucznej inteligencji od rdzenia naszych danych, ryzykujemy, że najpotężniejsze narzędzie produktywności, jakie kiedykolwiek stworzyliśmy, stanie się naszym największym wyzwaniem w zakresie bezpieczeństwa. Przyszłość ochrony danych w chmurze nie będzie należeć do tych, którzy budują najwyższe mury, ale do tych, którzy potrafią najprecyzyjniej zarządzać zaufaniem wewnątrz swoich systemów.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

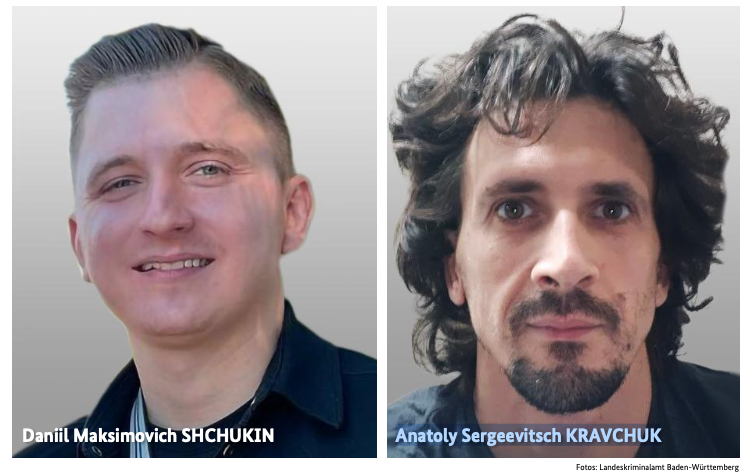

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi