Luki w OpenClaw AI Agent mogą umożliwić wstrzyknięcie poleceń i eksfiltrację danych

Foto: The Hacker News

Eksperci bezpieczeństwa odkryli poważne luki w OpenClaw AI, narzędziu przeznaczonym do automatyzacji zadań i interakcji między systemami. Badania wykazały, że podatności w mechanizmach uwierzytelniania mogą prowadzić do nieautoryzowanego wprowadzania poleceń (prompt injection) oraz potencjalnego wycieku wrażliwych danych. Analitycy z czołowych firm cyberbezpieczeństwa zidentyfikowali co najmniej trzy krytyczne punkty ryzyka, które umożliwiają złośliwym użytkownikom manipulację zachowaniem agenta AI. Szczególnie niebezpieczne są metody obchodzenia zabezpieczeń, które pozwalają na wprowadzanie ukrytych instrukcji przekierowujących przepływ informacji. Dla programistów i zespołów zajmujących się rozwojem AI oznacza to konieczność przeprowadzenia gruntownego audytu bezpieczeństwa oraz implementacji wielowarstwowych mechanizmów ochrony. Twórcy systemów AI będą musieli znacząco zrewidować dotychczasowe podejście do weryfikacji poleceń i kontroli dostępu. Można oczekiwać, że w najbliższych miesiącach nastąpi intensyfikacja prac nad udoskonaleniem protokołów bezpieczeństwa dla autonomicznych agentów AI.

Eksperci z chińskiego CNCERT (Krajowego Zespołu Reagowania na Awarie Sieci Komputerowych) ujawnili poważne luki bezpieczeństwa w autonomicznym agencie AI o nazwie OpenClaw, które mogą stanowić znaczące zagrożenie dla użytkowników i organizacji.

Ryzyko bezpieczeństwa w autonomicznych agentach AI

Oprogramowanie OpenClaw, znane wcześniej jako Clawdbot i Moltbot, zostało zidentyfikowane jako potencjalnie niebezpieczne narzędzie ze względu na słabe domyślne konfiguracje bezpieczeństwa. Analitycy cyberbezpieczeństwa ostrzegają, że takie luki mogą prowadzić do poważnych ataków, w tym:

- Nieautoryzowanego wstrzykiwania poleceń

- Wycieku poufnych danych

- Przejęcia kontroli nad systemem

Mechanizmy zagrożeń w OpenClaw

Głównym problemem są domyślne konfiguracje, które pozostawiają otwarte furty dla potencjalnych cyberprzestępców. Autonomiczne agenty AI, takie jak OpenClaw, często posiadają zaawansowane możliwości wykonywania złożonych zadań, co przy nieodpowiednim zabezpieczeniu może stanowić poważne ryzyko.

Czytaj też

Szczególnie niebezpieczne są metody prompt injection, które pozwalają na manipulację zachowaniem AI poprzez wprowadzenie specjalnie spreparowanych instrukcji. W przypadku OpenClaw takie działania mogą prowadzić do nieautoryzowanego dostępu do systemów i danych.

Implikacje dla polskich firm i użytkowników

Dla polskich przedsiębiorstw i specjalistów IT ostrzeżenie CNCERT stanowi kluczowy sygnał do weryfikacji własnych rozwiązań opartych na autonomicznych agentach AI. Konieczne jest:

- Dokładne sprawdzenie konfiguracji bezpieczeństwa

- Implementacja zaawansowanych mechanizmów ochrony

- Regularne audyty systemów AI

Przyszłość bezpieczeństwa autonomicznych systemów AI

Przypadek OpenClaw doskonale ilustruje rosnące wyzwania związane z bezpieczeństwem sztucznej inteligencji. Wraz z dynamicznym rozwojem technologii AI konieczne będzie ciągłe doskonalenie metod ochrony przed nowymi, coraz bardziej wyrafinowanymi zagrożeniami.

Eksperci przewidują, że w najbliższych latach nacisk zostanie położony na opracowanie kompleksowych standardów bezpieczeństwa dla autonomicznych systemów AI, które będą w stanie skutecznie przeciwdziałać zaawansowanym metodom cyberataków.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

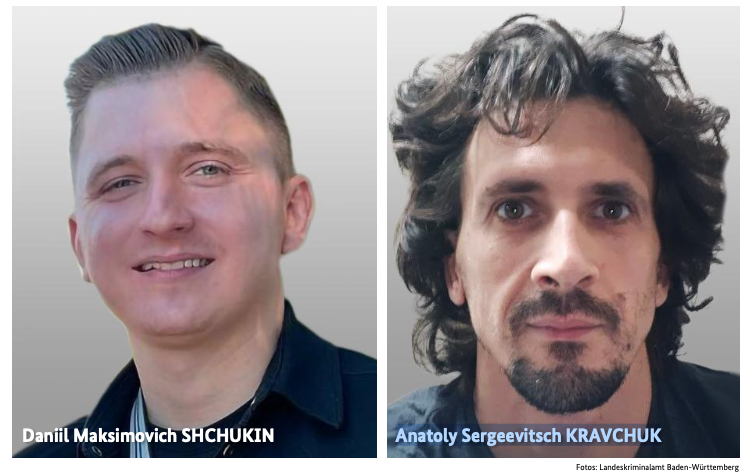

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi