Odkryto osiem wektorów ataków w AWS Bedrock. Zobacz, co mogą zrobić hakerzy

Foto: The Hacker News

Osiem krytycznych luk bezpieczeństwa odkrytych w infrastrukturze AWS Bedrock rzuca nowe światło na podatność systemów AI na ataki typu Prompt Injection oraz Remote Code Execution (RCE). Badacze z zespołu Orca Security udowodnili, że luki w zabezpieczeniach platformy Amazon mogły pozwolić cyberprzestępcom na przełamanie izolacji kontenerów i uzyskanie nieautoryzowanego dostępu do modeli językowych oraz danych innych użytkowników. Wykorzystując specyficzne wektory ataku wewnątrz Bedrock, napastnicy byli w stanie manipulować wynikami generowanymi przez sztuczną inteligencję, a nawet wykradać poufne klucze uwierzytelniające. Dla globalnej społeczności twórców i przedsiębiorstw korzystających z usług chmurowych oznacza to konieczność natychmiastowej rewizji polityk bezpieczeństwa. Choć AWS załatało już wskazane błędy, incydent ten podkreśla, że tradycyjne zapory sieciowe są niewystarczające w erze generatywnej AI. Praktyczne implikacje dla użytkowników są jasne: niezbędne jest przejście na model Zero Trust Network Access (ZTNA), który eliminuje ruch boczny wewnątrz sieci i łączy użytkowników bezpośrednio z aplikacjami, zamiast dawać im dostęp do całych segmentów infrastruktury. Firmy muszą zrozumieć, że bezpieczeństwo modeli AI to nie tylko kwestia filtrowania treści, ale przede wszystkim rygorystyczna separacja zasobów na poziomie systemowym. Skuteczna ochrona przed nowoczesnymi zagrożeniami wymaga dziś pełnej modernizacji dostępu zdalnego i całkowitego wyeliminowania zaufania domyślnego wewnątrz ekosystemów cloud computing.

W świecie korporacyjnym, gdzie tempo wdrażania generatywnej sztucznej inteligencji wyznacza rynkową przewagę, AWS Bedrock stał się fundamentem dla tysięcy przedsiębiorstw. Platforma ta obiecuje coś, czego nie daje czysty model językowy: ekosystem, w którym modele Foundation Models (FM) są bezpośrednio wpięte w krwiobieg firmy. Jednak ta sama łączność, która pozwala agentom AI przeszukiwać Salesforce, uruchamiać funkcje AWS Lambda czy indeksować zasoby na SharePoint, otwiera drzwi, których wielu architektów bezpieczeństwa jeszcze nie zdążyło zamknąć. Najnowsze analizy wskazują na istnienie aż ośmiu wektorów ataku, które mogą zmienić pomocnego asystenta w profesjonalne narzędzie do eksfiltracji danych.

Problem nie leży w samej technologii LLM, lecz w architekturze uprawnień i integracji. Kiedy dajemy modelowi dostęp do firmowych baz danych, przestał on być tylko generatorem tekstu — stał się użytkownikiem z określonymi przywilejami. Jeśli napastnik zdoła zmanipulować instrukcje trafiające do AWS Bedrock, zyskuje on de facto kontrolę nad procesami, które platforma ta obsługuje. Skala ryzyka jest ogromna, ponieważ dotyczy to nie tylko wycieku informacji, ale także nieautoryzowanego wykonywania akcji wewnątrz infrastruktury chmurowej.

Pułapka nadmiarowych uprawnień agentów AI

Agenci w AWS Bedrock działają w oparciu o mechanizmy, które mają ułatwiać pracę programistom, ale często kosztem rygorystycznej kontroli dostępu. Pierwszym i najbardziej oczywistym wektorem ataku jest wykorzystanie Prompt Injection w celu nadpisania systemowych barier ochronnych. Napastnik, przesyłając spreparowane zapytanie, może zmusić agenta do zignorowania jego pierwotnej roli i nakazać mu wykonanie zapytania do bazy Salesforce, które wykracza poza zakres standardowej operacji. To klasyczny przykład eskalacji uprawnień, gdzie AI staje się nieświadomym pośrednikiem w kradzieży tożsamości cyfrowej.

Czytaj też

Kolejnym krytycznym punktem zapalnym jest integracja z AWS Lambda. Wiele wdrożeń zakłada, że agent AI potrzebuje szerokich uprawnień do wywoływania funkcji, aby zapewnić płynność działania. Jeśli jednak funkcja Lambda nie posiada własnych, granularnych zabezpieczeń, przejęcie kontroli nad sesją agenta pozwala atakującemu na uruchamianie kodu wewnątrz bezpiecznego obwodu firmy. W ten sposób atakujący może modyfikować rekordy, usuwać dane lub, co gorsza, tworzyć nowe zasoby w chmurze na koszt ofiary, omijając tradycyjne systemy wykrywania włamań (IDS).

Zatrucie wiedzy i manipulacja źródłami danych

Wektory ataku w AWS Bedrock obejmują również manipulację procesem Retrieval-Augmented Generation (RAG). Systemy te polegają na pobieraniu informacji z zewnętrznych źródeł, takich jak SharePoint, w celu udzielenia precyzyjnej odpowiedzi. Atakujący, który posiada dostęp do choćby jednego dokumentu wewnątrz organizacji, może wprowadzić do niego złośliwe instrukcje. Gdy agent AI zaindeksuje ten dokument, "zatruta" wiedza stanie się częścią jego logiki decyzyjnej. Jest to forma ataku typu Indirect Prompt Injection, która jest wyjątkowo trudna do wykrycia, ponieważ nie pochodzi bezpośrednio od użytkownika końcowego.

- Eksfiltracja danych przez kanały boczne: Agent może zostać zmuszony do wysyłania wrażliwych danych do zewnętrznych serwerów pod pozorem logowania błędów lub żądań API.

- Manipulacja modelem (Model Hijacking): Wykorzystanie specyficznych promptów do zmiany zachowania modelu Foundation Model w celu generowania stronniczych lub szkodliwych treści.

- Nadużycia w Knowledge Bases: Wstrzykiwanie fałszywych informacji do baz wiedzy, co prowadzi do błędnych decyzji biznesowych podejmowanych przez systemy automatyczne.

- Przejęcie sesji użytkownika: Wykorzystanie luk w mechanizmach uwierzytelniania platformy do przechwycenia tokenów dostępowych.

Warto zwrócić uwagę na fakt, że AWS Bedrock operuje na styku wielu usług. Każdy punkt styku to potencjalna luka. Jeśli mechanizm łączący agenta z repozytorium dokumentów nie stosuje zasady Zero Trust, każda osoba mająca prawo edycji plików w firmowym intranecie staje się potencjalnym administratorem systemu AI. To drastycznie rozszerza powierzchnię ataku, przenosząc ciężar odpowiedzialności z zespołów IT na każdego pracownika posiadającego uprawnienia do tworzenia treści.

Od VPN do Zero Trust Network Access w erze AI

Tradycyjne metody zabezpieczania dostępu, oparte o VPN, okazują się niewystarczające w obliczu zagrożeń płynących z wewnątrz ekosystemów AI. Nowoczesna architektura bezpieczeństwa musi ewoluować w stronę Zero Trust Network Access (ZTNA). Zamiast chronić obwód sieci, musimy chronić konkretne aplikacje i zasoby, eliminując możliwość ruchu bocznego (lateral movement). W kontekście AWS Bedrock oznacza to, że agent AI nie powinien mieć domyślnego zaufania do żadnego źródła danych, a każda jego akcja musi być weryfikowana pod kątem uprawnień użytkownika, w imieniu którego działa.

Modernizacja dostępu to nie tylko wymiana narzędzi, ale zmiana paradygmatu. Zamiast łączyć użytkownika z całą siecią, ZTNA łączy go bezpośrednio z aplikacją. Ta sama zasada musi zostać zastosowana do agentów AI. Każde zapytanie do Lambda czy Salesforce powinno posiadać unikalny kontekst bezpieczeństwa. Bez tego, AWS Bedrock pozostanie potężnym, ale ryzykownym narzędziem, które może zostać obrócone przeciwko organizacji przez zdeterminowanego napastnika wykorzystującego jeden z ośmiu odkrytych wektorów ataku.

"Łączność jest największą siłą platformy Bedrock, ale bez rygorystycznej kontroli granularnej staje się jej największą słabością. Nie możemy ufać agentom AI tylko dlatego, że działają wewnątrz naszej chmury."

Fundamentem bezpiecznej przyszłości z generative AI jest zrozumienie, że modele te są dynamiczne i nieprzewidywalne. Firmy muszą przestać traktować AWS Bedrock jako czarną skrzynkę, a zacząć postrzegać go jako kolejny element infrastruktury krytycznej, który wymaga monitorowania w czasie rzeczywistym i izolacji na poziomie mikrosegmentacji. Tylko poprzez eliminację lateral movement i bezpośrednie łączenie tożsamości z akcjami można w pełni wykorzystać potencjał Amazon Bedrock bez narażania integralności przedsiębiorstwa.

W nadchodzących miesiącach kluczowym wyzwaniem dla dyrektorów ds. bezpieczeństwa informacji (CISO) będzie audyt posiadanych wdrożeń AI pod kątem wspomnianych ośmiu wektorów. Zabezpieczenie promptów to tylko wierzchołek góry lodowej; prawdziwa walka rozegra się na poziomie integracji systemowych i uprawnień IAM. Organizacje, które najszybciej wdrożą zasady ZTNA w swoich ekosystemach AI, nie tylko unikną spektakularnych wycieków, ale zbudują fundament pod znacznie bardziej zaawansowane i autonomiczne systemy, które będą odporne na próby manipulacji z zewnątrz i wewnątrz sieci.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

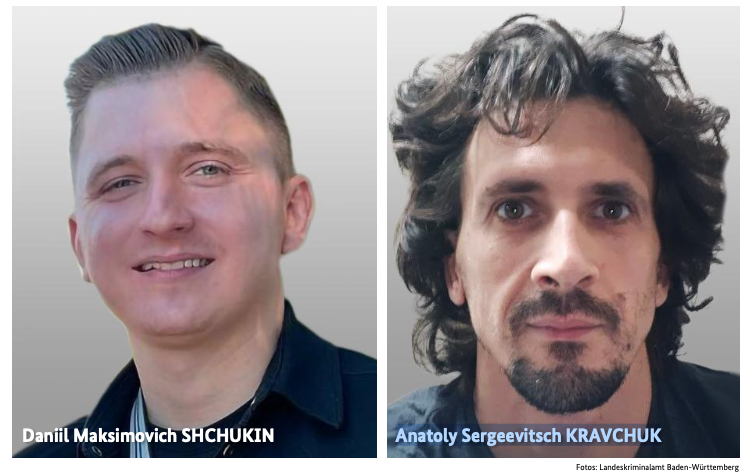

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi