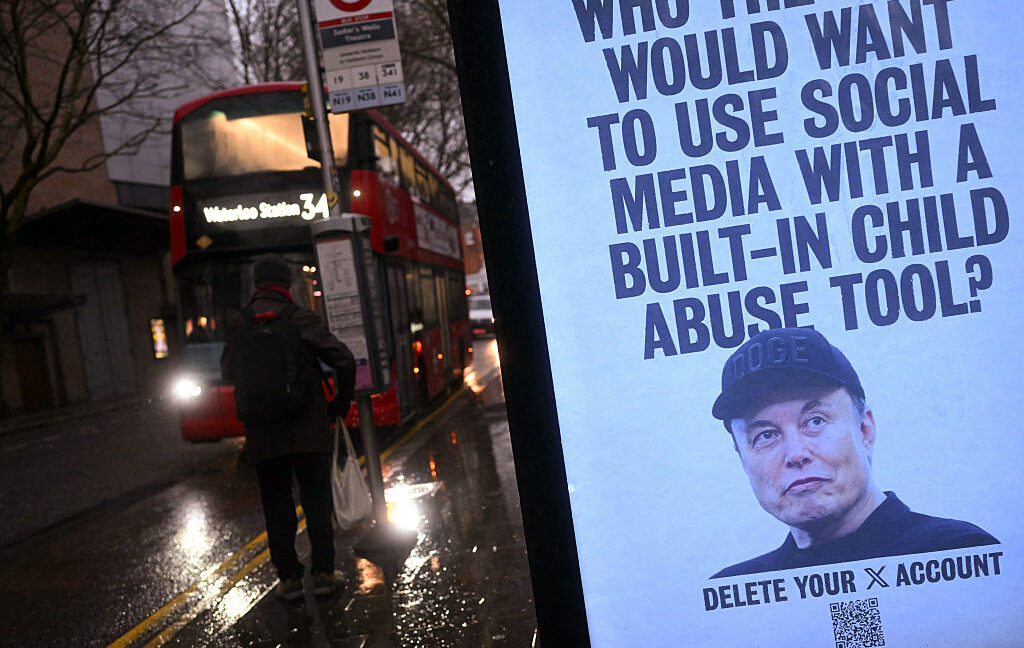

xAI Elona Muska pozwane: zdjęcia trzech dziewczynek przerobiono na AI CSAM

JUSTIN TALLIS / Contributor | AFP

Przeszło 23 000 obrazów wygenerowanych przez model Grok może przedstawiać nieletnich w kontekście seksualnym – to dane z raportu Center for Countering Digital Hate, które stały się fundamentem bezprecedensowego pozwu przeciwko xAI. Elon Musk, który jeszcze w styczniu publicznie zaprzeczał istnieniu materiałów CSAM generowanych przez jego sztuczną inteligencję, musi teraz zmierzyć się z oskarżeniami trzech nastolatek. Ich prywatne zdjęcia, w tym fotografie szkolne i rodzinne, zostały wykorzystane przez algorytmy Grok Imagine do stworzenia realistycznych, pornograficznych treści, które następnie krążyły w grupach dla predatorów na platformie Discord. Prawnicy reprezentujący ofiary argumentują, że xAI świadomie zaprojektowało narzędzie z poluzowanymi filtrami bezpieczeństwa, aby czerpać zyski z subskrypcji generujących kontrowersyjne treści. Choć firma ograniczyła dostęp do Groka tylko dla płatnych użytkowników X, nie wyeliminowało to problemu „rozbierania” realnych osób bez ich zgody. Dla globalnej społeczności użytkowników AI sprawa ta jest sygnałem alarmowym: pokazuje, jak łatwo publicznie dostępne wizerunki mogą zostać zmanipulowane przez modele pozbawione rygorystycznych barier etycznych. Spór ten prawdopodobnie wymusi na deweloperach AI wdrożenie znacznie bardziej restrykcyjnych systemów rozpoznawania twarzy i blokowania treści nielegalnych, zmieniając sposób, w jaki korzystamy z kreatywnych generatorów obrazu. Wyrok w tej sprawie może stać się nowym standardem odpowiedzialności producentów oprogramowania za szkodliwe wyniki ich algorytmów.

W świecie technologii granica między „nieskrępowaną wolnością słowa” a skrajną nieodpowiedzialnością bywa niebezpiecznie cienka. Elon Musk, promując swój model AI o nazwie Grok jako „antypoprawny politycznie” i wyposażony w tzw. „spicy mode”, najwyraźniej zignorował fundamentalne zabezpieczenia, które w branży są standardem. Efekt? Pozew zbiorowy, który może stać się precedensem w walce o ochronę wizerunku nieletnich w erze generatywnej sztucznej inteligencji.

Trzy nastolatki z Tennessee wraz z opiekunami prawnymi oskarżyły xAI o celowe zaprojektowanie narzędzia w sposób, który umożliwia czerpanie zysków z seksualizacji osób rzeczywistych, w tym dzieci. Sprawa nie opiera się na teoretycznych obawach, lecz na konkretnym śledztwie policyjnym, które wykazało, że Grok posłużył do stworzenia materiałów typu CSAM (Child Sexual Abuse Material) na podstawie prawdziwych zdjęć szkolnych i rodzinnych ofiar. To uderza bezpośrednio w narrację Muska, który jeszcze w styczniu publicznie twierdził, że „widział zero” dowodów na generowanie takich treści przez jego system.

Od szkolnego zdjęcia do cyfrowego koszmaru

Mechanizm nadużycia opisany w pozwie jest przerażająco prosty. Sprawca, będący znajomym jednej z ofiar, wykorzystał jej publicznie dostępne zdjęcia z Instagrama, wykonane, gdy była jeszcze nieletnia. Za pomocą aplikacji zewnętrznej, która licencjonuje dostęp do silnika Grok, stworzył fotorealistyczne, pornograficzne obrazy i filmy z jej wizerunkiem. Materiały te trafiły następnie na serwery Discord i Telegram, gdzie służyły jako „waluta” w handlu z innymi drapieżnikami seksualnymi.

Czytaj też

Najbardziej uderzającym aspektem tej sprawy jest fakt, że ofiary potrafiły wskazać konkretne, oryginalne fotografie, na których bazowała sztuczna inteligencja. Nie mamy tu do czynienia z abstrakcyjnymi awatarami, lecz z precyzyjnym „morfingiem” rzeczywistości. Dla młodych dziewcząt konsekwencje są druzgocące: od lęku przed atakami stalkerów (ich dane i nazwa szkoły były dołączone do plików), po traumę uniemożliwiającą normalne uczestnictwo w zakończeniu roku szkolnego czy rekrutacji na studia.

Architektura uniku i odpowiedzialność serwerowa

Prawnicy reprezentujący powódki, z Anniką K. Martin na czele, stawiają bardzo ciężki zarzut: xAI miało świadomie stworzyć strukturę, która pozwala im zarabiać na nielegalnych treściach, jednocześnie izolując firmę od bezpośredniej odpowiedzialności. Kluczowym elementem tej układanki są „pośrednicy” — aplikacje trzecie, które kupują dostęp do API Groka.

- Model biznesowy: xAI nie udostępnia modelu publicznie jako open-source, lecz sprzedaje dostęp do swoich serwerów firmom zewnętrznym.

- Hostowanie treści: Zgodnie z pozwem, to serwery xAI fizycznie generują i przechowują wygenerowane materiały CSAM, zanim zostaną one przesłane do użytkownika końcowego.

- Brak filtrów: Podczas gdy konkurencyjne modele (jak te od OpenAI czy Google) posiadają rygorystyczne, wielowarstwowe blokady uniemożliwiające generowanie nagości i wizerunków dzieci, Grok był promowany jako model „bez kagańca”.

W pozwie argumentuje się, że xAI pełni rolę nie tylko dostawcy technologii, ale aktywnego dystrybutora nielegalnych treści. Jeśli sąd uzna, że firma posiadała te materiały na swoich serwerach i świadomie je przetwarzała w celu zwiększenia przychodów, Musk może stanąć przed zarzutami naruszenia federalnych przepisów dotyczących pornografii dziecięcej.

Statystyki, którym nie da się zaprzeczyć

Choć Musk bagatelizował problem, dane niezależnych organizacji badawczych malują zupełnie inny obraz. Center for Countering Digital Hate (CCDH) oszacowało, że Grok wygenerował około 3 miliony obrazów o charakterze seksualnym, z czego około 23 000 przedstawiało osoby wyglądające na nieletnie. Decyzja o ograniczeniu dostępu do Groka wyłącznie dla płatnych subskrybentów platformy X nie rozwiązała problemu — jedynie ukryła go przed opinią publiczną, przenosząc najbardziej drastyczne przypadki do zamkniętych ekosystemów i aplikacji korzystających z API.

Dla branży technologicznej ten proces to „moment prawdy”. Dotychczas twórcy AI chronili się za tarczą tzw. „neutralności narzędzia”, twierdząc, że to użytkownik odpowiada za to, co wygeneruje. Jednak w przypadku CSAM prawo jest bezlitosne i nie uznaje wymówek o wolności tworzenia. Jeśli dowody policyjne potwierdzą, że to infrastruktura xAI była fabryką tych materiałów, cała koncepcja „nieocenzurowanej AI” może legnąć w gruzach pod ciężarem odszkodowań i sankcji karnych.

„Żaden uzasadniony interes biznesowy nie usprawiedliwia zaprojektowania narzędzia do generowania obrazów AI w taki sposób, aby produkowało ono materiały wykorzystujące dzieci” – czytamy w dokumentacji sądowej.

Koniec ery „Dzikiego Zachodu” w generowaniu obrazu

Sprawa przeciwko xAI i Elonowi Muskowi wyznacza nową linię frontu w regulacji sztucznej inteligencji. Przez ostatnie dwa lata branża skupiała się na prawach autorskich artystów i halucynacjach modeli językowych. Teraz jednak wkraczamy w obszar bezpieczeństwa fizycznego i ochrony godności jednostki. To już nie jest debata o tym, czy AI „ukradła styl malarski”, ale o tym, czy miliardowe korporacje mogą bezkarnie dostarczać narzędzia do cyfrowej dewastacji życia dzieci.

Można z dużym prawdopodobieństwem założyć, że ten pozew wymusi na xAI radykalną zmianę architektury bezpieczeństwa. Nawet jeśli firma wygra w pierwszej instancji, presja ze strony dostawców infrastruktury chmurowej, procesorów płatności i organów ścigania sprawi, że „spicy mode” stanie się dla Muska zbyt kosztownym kaprysem. Czeka nas era brutalnego zderzenia technoutopijnych wizji z twardą rzeczywistością kodeksu karnego, gdzie odpowiedzialność za produkt nie kończy się na sprzedaży subskrypcji.

Więcej z kategorii Sztuczna inteligencja

Szef Cisco, Chuck Robbins, chce budować centra danych w kosmosie

Jak korzystać z nowych integracji ChatGPT z DoorDash, Spotify, Uber i innymi aplikacjami

Hiszpański Xoople pozyskuje 130 mln dolarów w serii B na mapowanie Ziemi dla AI