How to Stop AI Data Leaks: A Webinar Guide to Auditing Modern Agentic Workflows

Foto: The Hacker News

Artificial Intelligence (AI) is no longer just a tool we talk to; it is a tool that does things for us. These are called AI Agents. They can send emails, move data, and even manage software on their own. But there is a problem. While these agents make work faster, they also open a new "back door" for hackers. The Problem: "The Invisible Employee" Think of an AI Agent like a new employee who has

W dynamicznie zmieniającym się świecie technologii sztucznej inteligencji pojawia się coraz więcej zagrożeń związanych z bezpieczeństwem danych. Agenckie przepływy pracy AI stają się nie tylko narzędziem zwiększającym efektywność, ale również potencjalnym źródłem ryzyka dla organizacji.

Rewolucja agentów AI: Między innowacją a zagrożeniem

Współczesne agenty AI to znacznie więcej niż proste narzędzia komunikacyjne. Są to zaawansowane systemy zdolne do samodzielnego podejmowania decyzji, wysyłania wiadomości, zarządzania oprogramowaniem i realizacji złożonych zadań. Przypominają one nowego, niewidzialnego pracownika, który może działać bez bezpośredniego nadzoru.

Dla polskich firm i startupów technologicznych oznacza to zarówno ogromną szansę, jak i poważne wyzwanie bezpieczeństwa. Agenty AI mogą znacząco przyspieszyć procesy biznesowe, ale jednocześnie stwarzają ryzyko niekontrolowanego wycieku wrażliwych informacji.

Read also

Kluczowe zagrożenia w środowiskach AI

Główne niebezpieczeństwa związane z agentami AI obejmują:

- Nieautoryzowany dostęp do systemów

- Przypadkowe ujawnienie poufnych danych

- Manipulację procesami biznesowymi

- Potencjalne ataki hakerskie przez "tylne wejścia"

Strategia Zero Trust: Kompleksowa ochrona

Eksperci ds. cyberbezpieczeństwa coraz częściej rekomendują podejście Zero Trust jako skuteczną metodę zabezpieczenia środowisk AI. Koncepcja ta zakłada, że żaden element systemu - niezależnie od tego, czy jest wewnętrzny, czy zewnętrzny - nie może być automatycznie uznany za zaufany.

W praktyce oznacza to wprowadzenie wielowarstwowych mechanizmów weryfikacji, które obejmują:

- Ciągłe uwierzytelnianie użytkowników

- Ograniczenie uprawnień dostępu

- Monitorowanie zachowań agentów AI

- Natychmiastową reakcję na podejrzane działania

Praktyczne wytyczne dla polskich firm

Dla polskich przedsiębiorstw wdrażających rozwiązania AI kluczowe jest:

- Regularne audyty bezpieczeństwa

- Szkolenia pracowników z zakresu bezpiecznego użycia AI

- Inwestycja w zaawansowane narzędzia monitorujące

- Opracowanie szczegółowych procedur reagowania na incydenty

Przyszłość agentów AI jest ekscytująca, ale wymaga kompleksowego podejścia do bezpieczeństwa. Tylko organizacje, które potrafią skutecznie balansować między innowacją a ochroną danych, będą mogły w pełni wykorzystać potencjał tej technologii.

Nadchodzące lata przyniosą zapewne kolejne rewolucyjne rozwiązania w dziedzinie bezpieczeństwa AI. Kluczem będzie ciągłe dostosowywanie strategii ochrony do zmieniającego się krajobrazu technologicznego.

More from Security

$285 Million Drift Hack Traced to Six-Month DPRK Social Engineering Operation

36 Malicious npm Packages Exploited Redis, PostgreSQL to Deploy Persistent Implants

Fortinet Patches Actively Exploited CVE-2026-35616 in FortiClient EMS

China-Linked TA416 Targets European Governments with PlugX and OAuth-Based Phishing

Related Articles

How LiteLLM Turned Developer Machines Into Credential Vaults for Attackers

Apr 6

Qilin and Warlock Ransomware Use Vulnerable Drivers to Disable 300+ EDR Tools

Apr 6

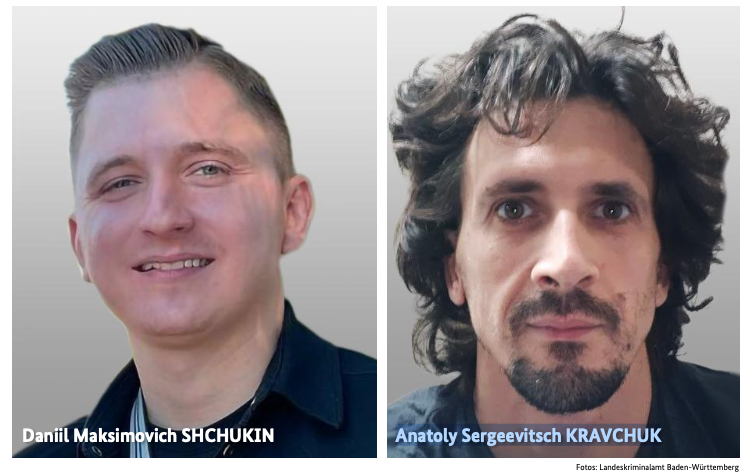

BKA Identifies REvil Leaders Behind 130 German Ransomware Attacks

Apr 6