Jak zapobiec wyciekom danych AI: Przewodnik webinarowy po audycie nowoczesnych przepływów pracy agenckich

Foto: The Hacker News

Czy wiesz, że ponad 60% firm obawia się niekontrolowanych wycieków danych w środowiskach AI? Najnowszy webinar ekspertów bezpieczeństwa cyfrowego przedstawia kompleksowe podejście do ochrony przepływów pracy opartych na sztucznej inteligencji. Kluczowym tematem jest strategia Zero Trust, która zakłada ciągłą weryfikację tożsamości i uprawnień użytkowników w każdym momencie interakcji z systemami. Specjaliści podkreślają konieczność implementacji zaawansowanych mechanizmów kontroli dostępu, zwłaszcza w kontekście generatywnych modeli AI. Przedstawione rozwiązania obejmują wielowarstwowe zabezpieczenia dla workforce, oddziałów firmowych oraz infrastruktury chmurowej. Szczególny nacisk położono na dynamiczne uwierzytelnianie i monitorowanie aktywności użytkowników w czasie rzeczywistym. Dla menedżerów IT i specjalistów ds. bezpieczeństwa oznacza to konieczność переосмислення dotychczasowych strategii ochrony danych. Można spodziewać się, że w najbliższych miesiącach coraz więcej organizacji będzie wdrażać kompleksowe podejście Zero Trust jako standardowy model zabezpieczeń w erze AI.

W dynamicznie zmieniającym się świecie technologii sztucznej inteligencji pojawia się coraz więcej zagrożeń związanych z bezpieczeństwem danych. Agenckie przepływy pracy AI stają się nie tylko narzędziem zwiększającym efektywność, ale również potencjalnym źródłem ryzyka dla organizacji.

Rewolucja agentów AI: Między innowacją a zagrożeniem

Współczesne agenty AI to znacznie więcej niż proste narzędzia komunikacyjne. Są to zaawansowane systemy zdolne do samodzielnego podejmowania decyzji, wysyłania wiadomości, zarządzania oprogramowaniem i realizacji złożonych zadań. Przypominają one nowego, niewidzialnego pracownika, który może działać bez bezpośredniego nadzoru.

Dla polskich firm i startupów technologicznych oznacza to zarówno ogromną szansę, jak i poważne wyzwanie bezpieczeństwa. Agenty AI mogą znacząco przyspieszyć procesy biznesowe, ale jednocześnie stwarzają ryzyko niekontrolowanego wycieku wrażliwych informacji.

Czytaj też

Kluczowe zagrożenia w środowiskach AI

Główne niebezpieczeństwa związane z agentami AI obejmują:

- Nieautoryzowany dostęp do systemów

- Przypadkowe ujawnienie poufnych danych

- Manipulację procesami biznesowymi

- Potencjalne ataki hakerskie przez "tylne wejścia"

Strategia Zero Trust: Kompleksowa ochrona

Eksperci ds. cyberbezpieczeństwa coraz częściej rekomendują podejście Zero Trust jako skuteczną metodę zabezpieczenia środowisk AI. Koncepcja ta zakłada, że żaden element systemu - niezależnie od tego, czy jest wewnętrzny, czy zewnętrzny - nie może być automatycznie uznany za zaufany.

W praktyce oznacza to wprowadzenie wielowarstwowych mechanizmów weryfikacji, które obejmują:

- Ciągłe uwierzytelnianie użytkowników

- Ograniczenie uprawnień dostępu

- Monitorowanie zachowań agentów AI

- Natychmiastową reakcję na podejrzane działania

Praktyczne wytyczne dla polskich firm

Dla polskich przedsiębiorstw wdrażających rozwiązania AI kluczowe jest:

- Regularne audyty bezpieczeństwa

- Szkolenia pracowników z zakresu bezpiecznego użycia AI

- Inwestycja w zaawansowane narzędzia monitorujące

- Opracowanie szczegółowych procedur reagowania na incydenty

Przyszłość agentów AI jest ekscytująca, ale wymaga kompleksowego podejścia do bezpieczeństwa. Tylko organizacje, które potrafią skutecznie balansować między innowacją a ochroną danych, będą mogły w pełni wykorzystać potencjał tej technologii.

Nadchodzące lata przyniosą zapewne kolejne rewolucyjne rozwiązania w dziedzinie bezpieczeństwa AI. Kluczem będzie ciągłe dostosowywanie strategii ochrony do zmieniającego się krajobrazu technologicznego.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

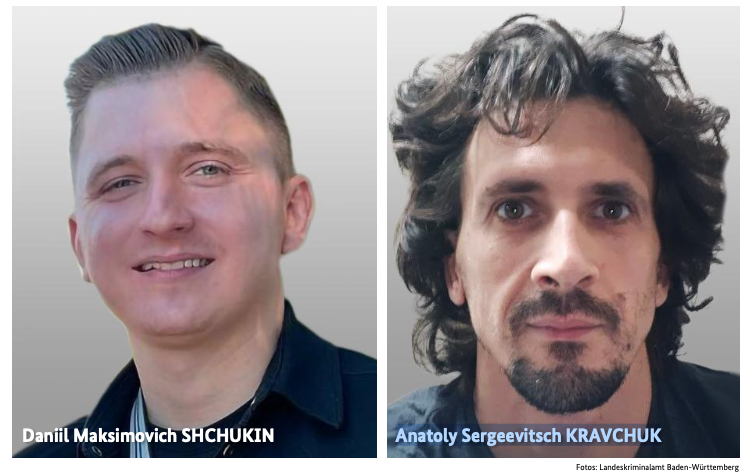

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi