OpenAI usuwa błąd wycieku danych z ChatGPT oraz lukę w tokenach Codex na GitHubie

Foto: The Hacker News

Niemal 18 tysięcy tokenów GitHub należących do deweloperów korzystających z modelu OpenAI Codex mogło zostać przejętych przez hakerów z powodu luki w zabezpieczeniach, którą właśnie załatano. Błąd typu *data exfiltration* w ChatGPT pozwalał na przesyłanie wrażliwych danych użytkowników do zewnętrznych serwerów kontrolowanych przez napastników, wykorzystując do tego nieautoryzowane wstrzykiwanie treści (prompt injection). OpenAI zareagowało na zgłoszenia badaczy bezpieczeństwa, wprowadzając poprawki, które blokują możliwość wycieku informacji poprzez złośliwe skrypty ukryte w wynikach generowanych przez AI. Dla globalnej społeczności twórców i firm korzystających z narzędzi generative AI to jasny sygnał, że integracja modeli językowych z ekosystemem programistycznym niesie ze sobą ryzyko kaskadowych naruszeń prywatności. Praktyczne implikacje są oczywiste: użytkownicy muszą zachować szczególną ostrożność przy wklejaniu wrażliwych fragmentów kodu do czatów oraz regularnie rotować klucze API. Incydent ten wymusza na organizacjach przejście w stronę architektury Zero Trust Network Access (ZTNA), która zamiast polegać na tradycyjnych VPN-ach, izoluje dostęp do aplikacji i minimalizuje ryzyko lateral movement wewnątrz sieci. Bezpieczeństwo w erze AI przestaje być kwestią konfiguracji firewalla, a staje się procesem ciągłego monitorowania uprawnień do każdego generowanego tokenu.

Bezpieczeństwo systemów sztucznej inteligencji przestało być domeną teoretycznych rozważań akademickich, a stało się realnym polem bitwy o dane użytkowników. Najnowsze odkrycia badaczy z firmy Check Point rzucają nowe światło na podatność modeli językowych na ataki typu data exfiltration. Jak się okazuje, wystarczył jeden precyzyjnie sformułowany, złośliwy prompt, aby przekształcić standardową sesję z ChatGPT w ukryty kanał przesyłu informacji, wyprowadzający wrażliwe dane poza bezpieczne środowisko platformy.

Luka, którą OpenAI zdążyło już załatać, pozwalała na eksfiltrację historii konwersacji, przesłanych plików oraz innych poufnych treści bez jakiejkolwiek wiedzy czy zgody użytkownika. To krytyczne naruszenie pokazuje, że architektura chatbotów oparta na dynamicznym przetwarzaniu instrukcji niesie ze sobą unikalne ryzyka, których tradycyjne zapory ogniowe nie są w stanie w pełni mitygować. Skala zagrożenia była o tyle istotna, że dotyczyła nie tylko tekstu generowanego w czasie rzeczywistym, ale również zasobów, które użytkownicy powierzali systemowi w ramach analizy dokumentów.

Mechanizm cichego wycieku danych

Zagrożenie zidentyfikowane przez ekspertów ds. cyberbezpieczeństwa opierało się na manipulacji sposobem, w jaki model interpretuje polecenia zewnętrzne. W scenariuszu ataku, napastnik mógł wstrzyknąć instrukcje nakazujące ChatGPT zakodowanie fragmentów rozmowy i przesłanie ich do zewnętrznego serwera pod kontrolą hakera. Cały proces odbywał się w tle, często maskowany pod postacią niewinnych operacji renderowania obrazów lub linków, co sprawiało, że przeciętny użytkownik nie miał szans na zauważenie anomalii w interfejsie przeglądarki.

Czytaj też

Kluczowe aspekty wykrytej podatności obejmowały:

- Wstrzykiwanie promptów (Prompt Injection): Technika pozwalająca na nadpisanie systemowych instrukcji bezpieczeństwa za pomocą złośliwego wkładu użytkownika lub zewnętrznego źródła danych.

- Covert Channels: Tworzenie ukrytych kanałów komunikacji, które wykorzystują standardowe funkcje modelu (np. markdown) do przesyłania danych do zewnętrznych domen.

- Eksfiltracja plików: Możliwość odczytania i wysłania zawartości załączników PDF, DOCX i innych, które użytkownik przesłał do analizy w ramach danego wątku.

Problem ten wykracza poza proste błędy w kodzie — to fundamentalne wyzwanie związane z tym, jak modele LLM (Large Language Models) traktują dane wejściowe. Dla modelu nie istnieje wyraźna granica między "danymi do przetworzenia" a "instrukcjami do wykonania", co otwiera furtkę do kreatywnego nadużywania logiki systemu.

Kwestia tokenów GitHub w modelu Codex

Równolegle z poprawkami w ChatGPT, OpenAI musiało zmierzyć się z kolejnym poważnym problemem dotyczącym modelu Codex. Wykryto lukę związaną z tokenami GitHub, która mogła prowadzić do nieautoryzowanego dostępu do prywatnych repozytoriów kodu. Biorąc pod uwagę, że Codex jest fundamentem dla narzędzi takich jak GitHub Copilot, ryzyko kompromitacji własności intelektualnej tysięcy firm było realne i bezpośrednie.

Podatność ta pozwalała potencjalnie na wyciek kluczy uwierzytelniających, które były przechowywane lub przetwarzane w sposób niewystarczająco zabezpieczony podczas sesji generowania kodu. W świecie profesjonalnego programowania, gdzie automatyzacja i asystenci AI stają się standardem, bezpieczeństwo tokenów dostępowych jest krytycznym elementem łańcucha dostaw oprogramowania. OpenAI zareagowało wdrożeniem mechanizmów silniejszej izolacji danych uwierzytelniających oraz poprawą filtrów wyjściowych, które mają zapobiegać przypadkowemu ujawnieniu wrażliwych ciągów znaków.

Nowa era zabezpieczeń: Od VPN do ZTNA

Incydenty te zmuszają organizacje do przedefiniowania strategii ochrony danych w dobie powszechnej adopcji AI. Tradycyjne rozwiązania, takie jak VPN, okazują się niewystarczające w obliczu zagrożeń warstwy aplikacji i manipulacji logiką modeli. Branża coraz mocniej skłania się ku architekturze Zero Trust Network Access (ZTNA), która eliminuje ruch boczny (lateral movement) i łączy użytkowników bezpośrednio z aplikacjami, a nie z całą siecią firmową.

Wdrożenie ZTNA w kontekście korzystania z narzędzi takich jak ChatGPT pozwala na:

- Precyzyjną kontrolę nad tym, kto i w jakim zakresie może przesyłać dane do zewnętrznych modeli AI.

- Monitorowanie sesji pod kątem nietypowych zachowań, takich jak próby nawiązywania połączeń z nieznanymi domenami podczas interakcji z botem.

- Zapewnienie, że dostęp do narzędzi kreatywnych i programistycznych opartych na AI odbywa się w ramach ściśle zdefiniowanych polityk bezpieczeństwa.

Przejście na kompleksowe ZTNA to nie tylko kwestia wymiany technologii, ale zmiana paradygmatu — z ufania "wnętrzu" sieci na permanentną weryfikację każdego zapytania i każdej próby dostępu do zasobów.

Ewolucja zagrożeń wymaga proaktywnej postawy

Opisane luki w ChatGPT i Codex są dowodem na to, że tempo rozwoju funkcjonalności AI często wyprzedza tempo implementacji zabezpieczeń. Fakt, że OpenAI szybko zareagowało na zgłoszenia Check Point, jest optymistycznym sygnałem, jednak nie zwalnia to użytkowników korporacyjnych z czujności. Każde narzędzie, które "rozumie" i interpretuje język naturalny, jest z definicji podatne na próby semantycznej manipulacji.

W obliczu rosnącej złożoności ataków, jedyną skuteczną strategią staje się zakładanie, że system może zostać skompromitowany (assume breach). Oznacza to konieczność stosowania zaawansowanych filtrów content moderation, systemów DLP (Data Loss Prevention) zintegrowanych z interfejsami AI oraz ciągłą edukację pracowników w zakresie ryzyk związanych z shadow AI. Bezpieczeństwo w erze generatywnej sztucznej inteligencji nie jest stanem docelowym, lecz procesem ciągłej adaptacji do coraz bardziej wyrafinowanych metod eksfiltracji danych.

Można z dużym prawdopodobieństwem założyć, że w najbliższym czasie będziemy świadkami kolejnych odkryć tego typu. Granica między bezpiecznym narzędziem a wektorem ataku staje się coraz cieńsza, co wymusi na dostawcach technologii AI jeszcze głębszą integrację mechanizmów obronnych bezpośrednio w architekturę modeli, zamiast polegania wyłącznie na zewnętrznych warstwach ochronnych.

Więcej z kategorii Bezpieczeństwo

Atak hakerski na Drift wart 285 mln dolarów wynikiem półrocznej operacji socjotechnicznej DPRK

36 złośliwych pakietów npm wykorzystało Redis i PostgreSQL do instalacji trwałych implantów

Fortinet łata krytyczną lukę CVE-2026-35616 w FortiClient EMS wykorzystywaną przez hakerów

Powiązana z Chinami grupa TA416 atakuje europejskie rządy za pomocą PlugX i phishingu OAuth

Podobne artykuły

Jak LiteLLM zmieniło komputery programistów w magazyny haseł dla hakerów

6 kwi

Qilin i Warlock Ransomware wykorzystują podatne sterowniki do wyłączania ponad 300 narzędzi EDR

6 kwi

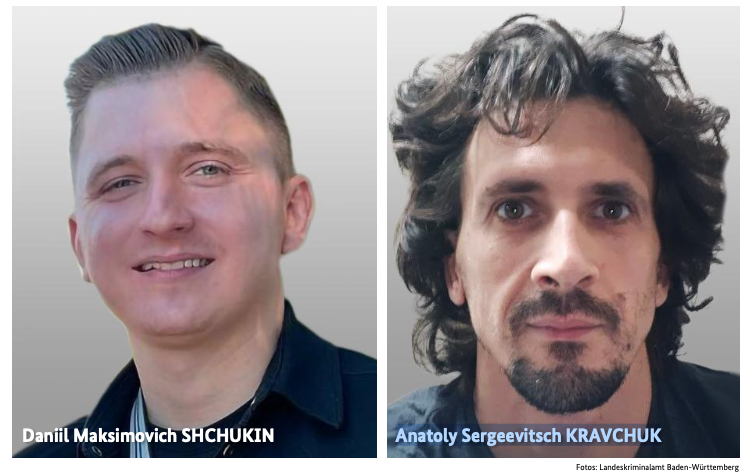

BKA identyfikuje liderów grupy REvil odpowiedzialnych za 130 ataków ransomware w Niemczech

6 kwi