Unsloth Studio

Foto: Product Hunt AI

Unsloth to narzędzie, które pozwala uruchamiać modele sztucznej inteligencji bezpośrednio na własnym sprzęcie, bez konieczności korzystania z usług chmurowych. Platforma zyskuje rosnące zainteresowanie wśród użytkowników poszukujących niezależności od dużych dostawców AI. Rozwiązanie adresuje rosnące obawy dotyczące prywatności danych i kosztów związanych z chmurowym przetwarzaniem. Dzięki Unsloth użytkownicy mogą pracować z modelami AI lokalnie, co oznacza pełną kontrolę nad informacjami oraz potencjalne oszczędności na abonamentach usług online. Produkt notuje wysoki rating 5.0 na Product Hunt, choć liczba opinii jest jeszcze ograniczona. Społeczność liczy 362 obserwujących, co sugeruje wczesny etap adopcji, ale z wyraźnym potencjałem wzrostu. Dla programistów i firm przetwarzających wrażliwe dane to szczególnie atrakcyjna alternatywa. Unsloth otwiera drogę do bardziej zdecentralizowanego ekosystemu AI, gdzie wydajność lokalnych systemów staje się konkurencyjna wobec rozwiązań chmurowych.

Unsloth to narzędzie, które zmienia fundamenty tego, jak pracujemy z modelami AI na naszych własnych komputerach. W erze, gdy giganci technologiczny jak OpenAI czy Google oferują dostęp do zaawansowanych modeli poprzez chmurę, pojawienie się rozwiązania umożliwiającego uruchomienie potężnych modeli lokalnie stanowi prawdziwy przełom. Platforma zdobyła doskonałą ocenę 5.0 na Product Hunt, co świadczy o tym, że społeczność deweloperów i entuzjastów AI dostrzega rzeczywistą wartość tego podejścia. To nie jest zwykła aplikacja — to zmiana paradygmatu w dostępie do sztucznej inteligencji.

Dlaczego ta zmiana jest tak istotna? Przyczyny są zarówno praktyczne, jak i ideologiczne. Po pierwsze, lokalne uruchamianie modeli AI oznacza pełną kontrolę nad danymi — nie trafiają one na serwery trzecich stron, co jest kluczowe dla firm zajmujących się wrażliwymi danymi, instytucji finansowych czy organizacji zdejmujących odpowiedzialność za prywatność. Po drugie, eliminuje zależność od dostępu do internetu i kosztów subskrypcji, które mogą szybko się sumować przy intensywnym użytkowaniu. Po trzecie, otwiera możliwości dla deweloperów pracujących w krajach o ograniczonym dostępie do usług chmurowych lub z problemami z przepustowością sieci.

Unsloth Studio pojawia się w momencie, gdy zainteresowanie lokalnym AI eksploduje. Coraz więcej osób zdaje sobie sprawę, że nie muszą być uzależnione od API czy usług chmurowych, aby pracować z najnowszymi modelami językowymi. Pytanie brzmi: czy Unsloth rzeczywiście dostarcza to, co obiecuje, i jak wpisuje się w szerszy ekosystem narzędzi do lokalnego AI?

Czytaj też

Co to jest Unsloth i jak działa?

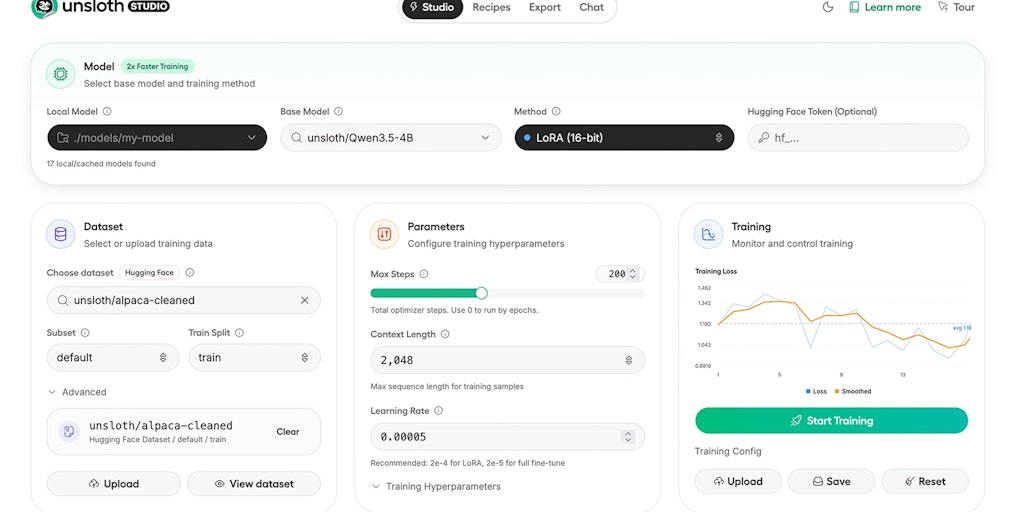

Unsloth to platforma zoptymalizowana pod kątem uruchamiania i trenowania dużych modeli języków (LLM) bezpośrednio na sprzęcie użytkownika. Nazwa jest znamienna — "unsloth" oznacza "rozpędzenie się", co dokładnie oddaje ideę stojącą za projektem. Chodzi o to, aby modele AI działały szybciej i efektywniej na lokalnym sprzęcie, zamiast czekać na odpowiedzi z chmury lub borykać się z opóźnieniami sieciowymi.

Podstawową ideą jest optymalizacja wydajności. Tradycyjnie uruchamianie dużych modeli AI wymaga ogromnych zasobów obliczeniowych — GPUs o wysokiej mocy, dużych ilości pamięci RAM i szybkich dysków SSD. Unsloth adresuje ten problem poprzez zaawansowane techniki optymalizacji, które pozwalają na uruchamianie modeli na bardziej skromnym sprzęcie bez drastycznych utraty wydajności. To jest techniczne osiągnięcie, które ma praktyczne konsekwencje dla tysięcy deweloperów.

Platforma obsługuje popularne modele open-source, takie jak Llama 2, Mistral czy Qwen. Użytkownicy mogą wybierać między różnymi rozmiarami modeli — od lżejszych wersji 7B parametrów, które działają na przeciętnych laptopach, po bardziej zaawansowane modele 70B, które wymagają potężniejszych GPU, ale są znacznie bardziej zdolne. To elastyczność jest kluczowa, bo pozwala każdemu znaleźć model odpowiadający jego sprzętowi i potrzebom.

Optymalizacja wydajności — gdzie Unsloth się wyróżnia

Rdzeń techniczny Unsloth polega na kilku kluczowych optymalizacjach. Po pierwsze, kwantyzacja modeli — technika zmniejszająca rozmiar modelu poprzez redukcję precyzji liczb, z których się składa. Zamiast przechowywać wagi sieci neuronowej w 32-bitowych liczbach zmiennoprzecinkowych, Unsloth może używać 8-bitowych lub nawet 4-bitowych reprezentacji. Dla większości zastosowań różnica w jakości odpowiedzi jest minimalna, a oszczędności w zużyciu pamięci są dramatyczne.

Po drugie, optymalizacje na poziomie kerneli GPU. Unsloth napisane jest z myślą o maksymalnym wykorzystaniu możliwości nowoczesnych procesorów graficznych, szczególnie kart NVIDIA. Kod jest zoptymalizowany pod kątem CUDA — platformy obliczeniowej Nvidii — co oznacza, że modele działają znacznie szybciej niż przy użyciu generycznych implementacji. To nie jest magiczny trick, ale konsekwentna praca nad każdym aspektem kodu.

Po trzecie, efektywne trenowanie poprzez techniki takie jak LoRA (Low-Rank Adaptation). Zamiast trenować wszystkie parametry modelu od zera — co byłoby niezwykle kosztowne obliczeniowo — LoRA pozwala na dostrojenie modelu poprzez dodanie małych, niskorangowych warstw. To oznacza, że można dostosować zaawansowany model do specjalistycznych zadań przy ułamku kosztów obliczeniowych tradycyjnego trenowania.

Te optymalizacje nie są nowe — są znane w branży od kilku lat. Jednak Unsloth je integruje w spójny, łatwy w użyciu pakiet, co stanowi znaczną wartość dodaną. Zamiast samodzielnie łatać różne biblioteki i rozwiązania, użytkownik ma gotowy zestaw narzędzi.

Praktyczne zastosowania dla polskich twórców i firm

W Polsce ekosystem AI jest jeszcze rozwijający się, ale dynamiczny. Unsloth otwiera konkretne możliwości dla różnych grup. Startupów AI mogą korzystać z platformy do prototypowania rozwiązań bez ogromnych inwestycji w infrastrukturę chmurową. Zamiast płacić OpenAI za każdy request do API, mogą uruchomić własny model lokalnie i eksperymentować z niskim kosztem.

Dla agencji kreatywnych zajmujących się tworzeniem treści, Unsloth otwiera możliwość budowy wewnętrznych narzędzi do generowania tekstu, obrazów czy kodów bez zależności od usług zewnętrznych. To szczególnie ważne, gdy trzeba pracować z poufnymi danymi klientów — lokalne modele gwarantują, że żadne dane nie opuszczają infrastruktury firmy.

Naukowcy i akademicy mogą wykorzystać Unsloth do eksperymentów z nowymi architekturami modeli bez potrzeby dostępu do drogiego sprzętu obliczeniowego. Polskie uniwersytety, które mają ograniczone budżety na badania AI, mogą znacznie bardziej efektywnie wykorzystywać swoje istniejące GPU.

Dla deweloperów indywidualnych i hobbystów, Unsloth demokratyzuje dostęp do AI. Nie musisz być pracownikiem dużej korporacji, aby pracować z najnowocześniejszymi modelami. Wystarczy laptop z przyzwoitym GPU i chęć nauki.

Ograniczenia i wyzwania, które trzeba znać

Jednak przed zainstalowaniem Unsloth warto zrozumieć ograniczenia tego podejścia. Po pierwsze, wymagania sprzętowe. Chociaż Unsloth optymalizuje wydajność, uruchamianie modeli LLM wciąż wymaga przyzwoitego GPU. Laptopy z zintegrowanymi kartami graficznymi mogą mieć problemy — nawet zoptymalizowane modele 7B mogą działać powoli na słabszym sprzęcie. Użytkownicy bez dedykowanego GPU będą zawiedzeni.

Po drugie, krzywa uczenia się. Unsloth jest narzędziem dla technicznych użytkowników — programistów i inżynierów. Jeśli nigdy nie pracowałeś z Pythonem, CUDA czy modelami transformerów, wdrożenie Unsloth będzie frustrujące. Dokumentacja jest dobra, ale nie jest to narzędzie typu "kliknij i uruchom".

Po trzecie, ograniczenia modeli. Nawet najlepsze dostępne modele open-source, takie jak Mistral czy Llama 2, nie dorównują wydajności najnowszych modeli od OpenAI czy Google. GPT-4 i Claude 3 są po prostu bardziej zdolne. Jeśli potrzebujesz absolutnie najlepszej wydajności, lokalne modele mogą być niewystarczające.

Po czwarte, bieżące aktualizacje i wsparcie. Ekosystem open-source AI zmienia się szybko. Unsloth musi stale aktualizować się, aby wspierać nowe modele i optymalizacje. Pytanie, czy zespół za tym projektem ma zasoby, aby utrzymać tempo rozwoju branży.

Unsloth w kontekście konkurencji

Unsloth nie jest jedynym graczem na rynku lokalnego AI. Ollama to popularna alternatywa, która również pozwala na uruchamianie modeli lokalnie. Ollama jest bardziej przyjazna dla początkujących — ma prostszy interfejs i nie wymaga głębokich umiejętności programistycznych. Jednak Unsloth jest bardziej zaawansowany i oferuje lepsze optymalizacje dla zaawansowanych użytkowników.

LM Studio to kolejna alternatywa z GUI, która również upraszcza proces uruchamiania modeli. Dla użytkowników preferujących interfejs graficzny zamiast linii poleceń, LM Studio może być bardziej atrakcyjny. Jednak znowu, jeśli chodzi o czystą wydajność i optymalizacje, Unsloth oferuje więcej.

Porównując Unsloth do komercyjnych usług chmurowych, równanie jest bardziej złożone. OpenAI API czy Anthropic Claude API oferują niezrównaną wydajność i niezawodność, ale za cenę. Dla projektów, gdzie koszt jest krytycznym czynnikiem lub gdzie prywatność danych jest absolutnie niezbędna, Unsloth wygrywa. Dla projektów wymagających najlepszej możliwej jakości odpowiedzi, chmura pozostaje lepszym wyborem.

Przyszłość lokalnego AI i rola Unsloth

Trend w kierunku lokalnego AI będzie się wzmacniać. Kilka czynników napędza ten rozwój: rosnące obawy dotyczące prywatności danych, regulacje takie jak RODO w Europie, chęć zmniejszenia kosztów operacyjnych, oraz coraz lepsze optymalizacje, które sprawiają, że modele działają szybciej na słabszym sprzęcie.

Unsloth pozycjonuje się jako kluczowe narzędzie w tym ekosystemie. Jeśli zespół za projektem będzie utrzymywać tempo innowacji i wspierać nowe modele i optymalizacje, może stać się standardowym narzędziem dla deweloperów pracujących z lokalnym AI. Ocena 5.0 na Product Hunt sugeruje, że społeczność już to dostrzega.

Jednak sukces nie jest gwarantowany. Konkurencja w przestrzeni open-source AI jest zacięta, a duże firmy takie jak Meta czy Microsoft również inwestują w narzędzia do lokalnego AI. Unsloth musi znaleźć swoją niszę — i wydaje się, że ta nisza to zaawansowani użytkownicy szukający maksymalnej wydajności i optymalizacji.

Praktyczne kroki, aby zacząć z Unsloth

Jeśli jesteś zainteresowany wypróbowaniem Unsloth, oto co powinieneś wiedzieć. Po pierwsze, sprawdź swój sprzęt. Idealne jest GPU od Nvidii z co najmniej 8 GB pamięci VRAM. GPU AMD może działać, ale wsparcie jest słabsze. Procesory CPU mogą pracować, ale będą znacznie wolniejsze.

Po drugie, zainstaluj wymagane zależności. Będziesz potrzebować Pythona, CUDA toolkit od Nvidii, oraz bibliotek takich jak PyTorch. Proces instalacji jest dobrze udokumentowany, ale wymaga pewnej wiedzy technicznej.

Po trzecie, wybierz model. Zacznij od czegoś lekkiego, takiego jak Mistral 7B, aby zobaczyć, jak to działa na twoim sprzęcie. Gdy się zapoznasz z platformą, możesz eksperymentować z większymi modelami.

Po czwarte, dostrojenie modelu. To jest miejsce, gdzie Unsloth naprawdę się wyróżnia. Użyj LoRA, aby dostosować model do swoich specjalistycznych zadań. Dokumentacja Unsloth zawiera świetne przykłady, jak to zrobić.

Unsloth Studio reprezentuje ważny moment w demokratyzacji AI. Narzędzie to pokazuje, że nie musisz być gigantyczną korporacją, aby pracować z najnowocześniejszymi modelami. Dla polskich deweloperów, firm i naukowców, to otwiera nowe możliwości — zarówno techniczne, jak i biznesowe. Czy Unsloth stanie się standardowym narzędziem? To zależy od tego, czy zespół będzie w stanie utrzymać tempo innowacji i wspierać rosnącą społeczność użytkowników.

Więcej z kategorii Technologia

Podobne artykuły

Po przegranej w sądzie RFK Jr. zwiększa swoje wpływy w panelu CDC ds. szczepionek

6 kwi

Steven Spielberg wciąż planuje nakręcić horror: „Kiedyś to zrobię”

6 kwiSąd apelacyjny USA: New Jersey nie może zakazać rynków prognostycznych Kalshi

6 kwi