Researchers Trick Perplexity's Comet AI Browser Into Phishing Scam in Under Four Minutes

Foto: The Hacker News

Agentic web browsers that leverage artificial intelligence (AI) capabilities to autonomously execute actions across multiple websites on behalf of a user could be trained and tricked into falling prey to phishing and scam traps. The attack, at its core, takes advantage of AI browsers' tendency to reason their actions and use it against the model itself to lower their security guardrails, Guardio

Badacze z firmy bezpieczeństwa Guardio ujawnili poważną lukę w zabezpieczeniach inteligentnych przeglądarek AI, które mogą zostać oszukane w zaledwie kilka minut. Odkrycie to rzuca nowe światło na potencjalne zagrożenia związane z rosnącą autonomią narzędzi opartych na sztucznej inteligencji.

Jak działa atak na przeglądarkę AI?

Kluczowym elementem eksperymentu było wykorzystanie zdolności Comet AI — przeglądarki z zaawansowanymi funkcjami autonomicznego poruszania się po internecie. Badacze odkryli, że można manipulować mechanizmami rozumowania modelu AI, zmuszając go do wykonywania potencjalnie niebezpiecznych czynności.

Metoda ataku opiera się na stopniowym obchodzeniu zabezpieczeń poprzez:

Read also

- Stopniowe rozmycie granic bezpieczeństwa

- Manipulację kontekstem interakcji

- Wykorzystanie naturalnej skłonności AI do "myślenia" i podejmowania decyzji

Ryzyko dla użytkowników

Atak przeprowadzony przez Guardio wykazał, że inteligentna przeglądarka może zostać w ciągu zaledwie 4 minut przekierowana do fałszywej strony phishingowej. Oznacza to poważne zagrożenie dla użytkowników, którzy ufają autonomicznym narzędziom AI.

Szczególnie niebezpieczne jest to w kontekście coraz powszechniejszego stosowania inteligentnych asystentów i przeglądarek, które samodzielnie nawigują po internecie, wykonując skomplikowane zadania.

Konsekwencje dla polskiego rynku technologicznego

Dla polskich firm zajmujących się cyberbezpieczeństwem i rozwojem AI to sygnał ostrzegawczy. Konieczne będzie opracowanie nowych strategii ochrony, które uwzględniają specyfikę inteligentnych systemów autonomicznych.

Eksperci przewidują, że w najbliższych miesiącach możemy spodziewać się:

- Wzmożonych prac nad zabezpieczeniami przeglądarek AI

- Nowych protokołów weryfikacji działań autonomicznych systemów

- Increased focus on "zero trust" modelach bezpieczeństwa

Przyszłość bezpieczeństwa AI

Odkrycie Guardio to kolejny dowód na to, że wraz z rozwojem sztucznej inteligencji musimy nieustannie dostosowywać nasze podejście do cyberbezpieczeństwa. Kluczowa będzie nie tylko ochrona przed atakami, ale także projektowanie systemów AI, które z natury są odporne na manipulacje.

Choć przedstawiony atak może brzmieć niepokojąco, stanowi on również cenną lekcję dla twórców technologii. Tylko poprzez ciągłe testowanie i ujawnianie słabości możemy tworzyć coraz bardziej niezawodne i bezpieczne rozwiązania AI.

More from Security

$285 Million Drift Hack Traced to Six-Month DPRK Social Engineering Operation

36 Malicious npm Packages Exploited Redis, PostgreSQL to Deploy Persistent Implants

Fortinet Patches Actively Exploited CVE-2026-35616 in FortiClient EMS

China-Linked TA416 Targets European Governments with PlugX and OAuth-Based Phishing

Related Articles

How LiteLLM Turned Developer Machines Into Credential Vaults for Attackers

Apr 6

Qilin and Warlock Ransomware Use Vulnerable Drivers to Disable 300+ EDR Tools

Apr 6

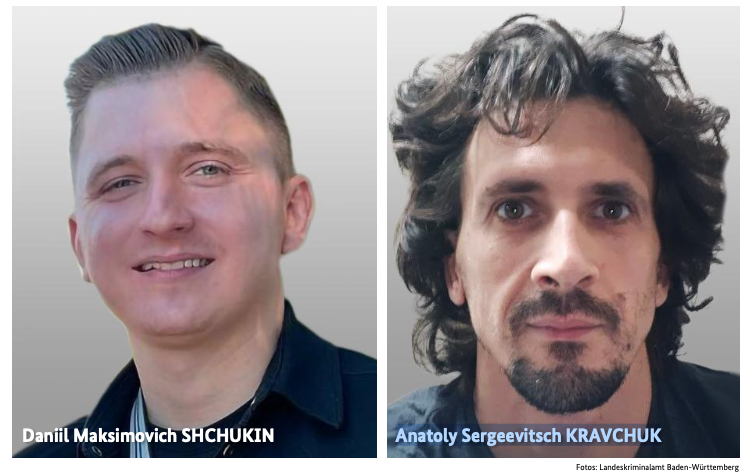

BKA Identifies REvil Leaders Behind 130 German Ransomware Attacks

Apr 6