Anthropic zmaga się z chińską konkurencją i własną obsesją na punkcie bezpieczeństwa

Foto: The Register

Zaledwie 13,3% udziału w rynku – do takiego poziomu w marcu 2026 roku spadły wpływy Anthropic, tracąc ponad połowę swojej pozycji w ciągu zaledwie dwunastu miesięcy. Twórcy modeli Claude, mimo zebrania 30 miliardów dolarów finansowania, mierzą się z brutalną rzeczywistością finansową: przy przychodach rzędu 5 miliardów dolarów, same koszty treningu i inferencji pochłonęły aż 10 miliardów. Ta dysproporcja rzuca cień na plany debiutu giełdowego (IPO) zaplanowanego na czwarty kwartał 2026 roku. Głównym zagrożeniem okazuje się ofensywa chińskich laboratoriów AI. W rankingach popularności platformy OpenRouter modele z Chin, takie jak DeepSeek czy MiniMax, zajmują obecnie całe podium, spychając Claude Opus 4.6 na odległe, siódme miejsce. Dla użytkowników globalnych kluczowy jest rachunek ekonomiczny: chińska konkurencja oferuje 90% jakości modelu Opus za zaledwie 7% jego ceny. Anthropic dodatkowo ogranicza użyteczność swoich narzędzi poprzez restrykcyjne limity tokenów w godzinach szczytu oraz silną obsesję na punkcie bezpieczeństwa (safety), co w oczach wielu deweloperów czyni modele mniej elastycznymi. Sytuacja ta pokazuje, że etyczne podejście i zaawansowane safeguardy mogą stać się biznesowym obciążeniem w starciu z agresywną, niskokosztową konkurencją. Bez systemowych rozwiązań chroniących własność intelektualną, pionierzy bezpiecznej sztucznej inteligencji ryzykują utratę płynności finansowej na rzecz wydajniejszych ekonomicznie rywali.

W świecie sztucznej inteligencji, gdzie kapitał płynie strumieniami, a ambicje sięgają kolonizacji cyfrowego intelektu, **Anthropic** zdawał się być ostoją etyki i bezpieczeństwa. Jednak najnowsze dane finansowe i rynkowe malują obraz firmy, która wpada w pułapkę własnych zasad. Podczas gdy twórcy modelu **Claude** przygotowują się do debiutu giełdowego planowanego na **czwarty kwartał 2026 roku**, na horyzoncie piętrzą się problemy, których nie rozwiąże sama ideologia „odpowiedzialnej AI”.

Sytuacja finansowa spółki jest daleka od ideału, co ujawnił CFO **Krishna Rao** w niedawnym wniosku prawnym. Mimo pozyskania oszałamiającej kwoty **30 miliardów dolarów** od inwestorów, Anthropic wygenerował dotychczas zaledwie **5 miliardów dolarów** przychodu. Dla porównania, koszty samego treningu modeli i inferencji pochłonęły już **10 miliardów dolarów**. Ta dysproporcja zmusza firmę do wprowadzania desperackich kroków oszczędnościowych, takich jak ograniczanie limitów tokenów w godzinach szczytu, co rzadko jest sygnałem siły rynkowej.

Chińska dominacja na listach przebojów LLM

Największym zagrożeniem dla Anthropic nie jest jednak ich własny arkusz kalkulacyjny, lecz błyskawiczny postęp laboratoriów z Chin. Według raportu **US-China Economic and Security Review Commission**, chińskie firmy nie tylko zniwelowały dystans do zachodnich liderów, ale zaczęły wyznaczać standardy architektoniczne, które obecnie adaptuje cała branża. Skalę tego zjawiska najlepiej obrazuje ranking popularności na platformie **OpenRouter**, która agreguje dostęp do najróżniejszych modeli poprzez jedno API.

Czytaj też

Obecnie cała pierwsza szóstka najpopularniejszych modeli pochodzi z Chin. Są to kolejno:

- MiMo-V2-Pro (Xiaomi)

- Step 3.5 Flash (stepfun)

- DeepSeek V3.2 (DeepSeek)

- MiniMax M2.7 (MiniMax)

- MiniMax M2.5 (MiniMax)

- GLM 5 Turbo (z.ai)

Flagowe produkty Anthropic – Claude Opus 4.6 oraz Claude Sonnet 4.6 – spadły odpowiednio na siódme i ósme miejsce. Jeszcze bardziej niepokojący jest spadek udziału w rynku: w marcu 2025 roku Anthropic kontrolował 29,1% zapytań, by rok później, 21 marca 2026 roku, zjechać do poziomu zaledwie 13,3%. To drastyczna erozja pozycji rynkowej w ciągu zaledwie dwunastu miesięcy.

Ekonomia kontra etyka: Dziesięciokrotna różnica w cenie

Problemem Anthropic jest nie tylko wydajność, ale przede wszystkim bezlitosna ekonomia. Chińscy konkurenci oferują zbliżoną jakość za ułamek ceny. Analiza przeprowadzona przez Kilo Code wykazała, że model MiniMax M2.7 dostarcza 90% jakości oferowanej przez Claude 4.6 Opus, kosztując przy tym zaledwie 7% jego ceny. W liczbach bezwzględnych oznacza to wydatek rzędu 0,27 USD zamiast 3,67 USD za to samo zadanie.

Anthropic odpiera te ataki, oskarżając firmy takie jak MiniMax, Moonshot AI czy DeepSeek o „destylację” swoich modeli, czyli trenowanie ich na danych wyjściowych generowanych przez Claude'a. Jest to argument o tyle ryzykowny, że same modele Anthropic powstawały na bazie treści pobieranych z sieci bez wyraźnej zgody twórców. Bez interwencji politycznej i ochrony rynkowej, firma może nie być w stanie utrzymać marż niezbędnych do osiągnięcia dodatnich przepływów pieniężnych przed wejściem na giełdę.

Obsesja bezpieczeństwa paraliżuje specjalistów

Najbardziej kontrowersyjnym aspektem strategii Anthropic pozostaje jednak ich podejście do bezpieczeństwa, które zaczyna przypominać cenzurę paraliżującą profesjonalne zastosowania. Firma, która zyskała uznanie opierając się naciskom Departamentu Obrony USA w kwestii poluzowania zabezpieczeń, teraz traci użytkowników przez nadgorliwość swoich algorytmów. Społeczność badaczy cyberbezpieczeństwa masowo rezygnuje z subskrypcji, skarżąc się na „stupid number of false positives” (absurdalną liczbę błędnych blokad).

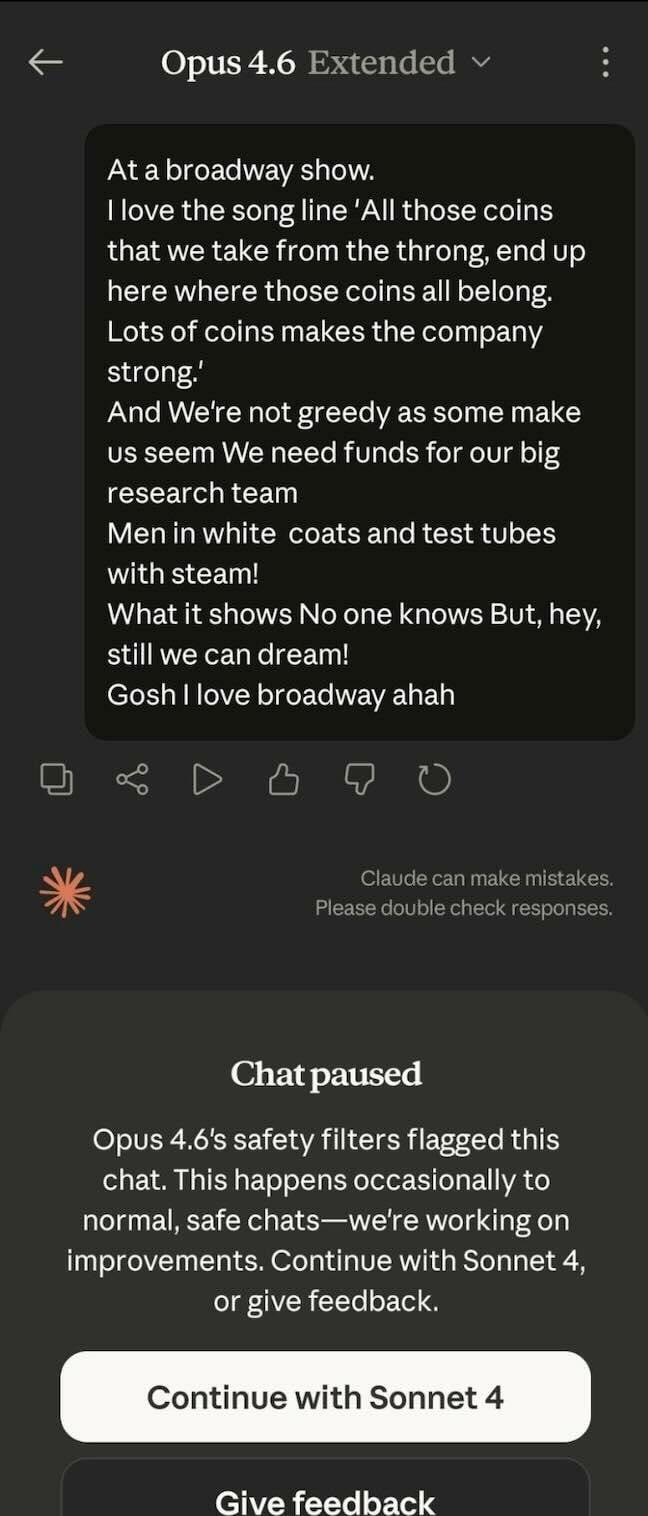

Nowe zabezpieczenia wprowadzone wraz z premierą Opus 4.6 w lutym 2026 roku miały chronić przed nadużyciami typu CBRN (chemicznymi, biologicznymi, radiologicznymi i nuklearnymi). W praktyce jednak mechanizmy te są tak czułe, że potrafią zablokować czat na temat musicalu „Urinetown”, uznając go za zagrożenie. Dla ekspertów od bug huntingu i testów penetracyjnych, Claude stał się narzędziem bezużytecznym.

Anthropic przyznaje, że ich guardrails mogą blokować legalne działania defensywne, oferując specjalny formularz o zwolnienie z blokad dla profesjonalistów. Proces ten jest jednak opisywany jako powolny i mało transparentny. Efekt? Badacze, którzy wcześniej płacili za subskrypcje Max (200 USD miesięcznie), przenoszą się do chińskich alternatyw. Jeden z rozmówców wprost wskazuje na MiniMax jako „destylowaną wersję Claude’a”, która jest tańsza, równie dobra i – co kluczowe – nie unika trudnych tematów w kontekście badawczym.

Jeśli Anthropic nie znajdzie złotego środka między swoją misją tworzenia „nieszkodliwej” AI a brutalnymi wymaganiami rynku i specjalistów, ich debiut giełdowy w 2026 roku może okazać się bolesnym zderzeniem z rzeczywistością. W branży, gdzie lojalność użytkowników kończy się tam, gdzie zaczyna się dziesięciokrotnie wyższy rachunek lub zablokowany prompt, etyczny puryzm może stać się najkrótszą drogą do rynkowej marginalizacji.

Więcej z kategorii Branża

Broadcom rozszerza współpracę z Google oraz Anthropic w zakresie dostaw chipów

OpenAI prosi organy w California i Delaware o zbadanie „antykonkurencyjnych zachowań” Muska przed kwietniowym procesem

Nadzieja na układ USA-Iran, rocznica Apple i OpenAI w Morning Squawk

Boom centrów danych AI wystawia ubezpieczycieli na próbę przy napływie prywatnego kapitału

Podobne artykuły

Ryzykowny i niezwykle ambitny plan Intel, który może przynieść miliardy zysku

6 kwi

Badacze nie chcieli gloryfikować cyberprzestępców, więc postanowili ich wyśmiać

5 kwi

Agenci AI obiecują „prowadzenie biznesu”, ale kto odpowie za ich błędy?

5 kwi